Embora o rompimento de Washington com a Anthropic expusesse a completa falta de quaisquer regras coerentes que regem a inteligência artificial, uma coligação bipartidária de pensadores reuniu algo que o governo até agora se recusou a produzir: um quadro para como deveria realmente ser o desenvolvimento responsável da IA.

A Declaração Pró-Humana foi finalizada antes do impasse Pentágono-Antrópico da semana passada, mas a colisão dos dois eventos não passou despercebida a ninguém envolvido.

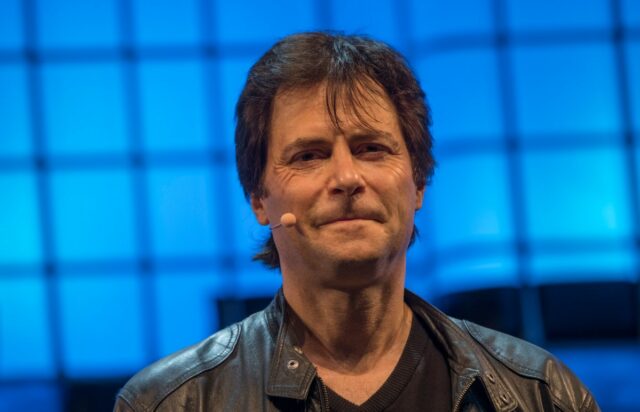

“Algo bastante notável aconteceu na América apenas nos últimos quatro meses”, disse Max Tegmark, o físico do MIT e investigador de IA que ajudou a organizar o esforço, em conversa com este editor. “As pesquisas de repente (mostraram) que 95% de todos os americanos se opõem a uma corrida não regulamentada à superinteligência.”

O documento recentemente publicado, assinado por centenas de especialistas, antigos funcionários e figuras públicas, abre com a observação sensata de que a humanidade se encontra numa bifurcação na estrada. Um caminho, que a declaração chama de “a corrida para substituir”, leva a que os humanos sejam suplantados primeiro como trabalhadores, depois como decisores, à medida que o poder é acumulado para instituições irresponsáveis e para as suas máquinas. A outra leva à IA que expande enormemente o potencial humano.

O último cenário depende de cinco pilares principais: manter os humanos no comando, evitar a concentração de poder, proteger a experiência humana, preservar a liberdade individual e responsabilizar legalmente as empresas de IA. Entre as suas disposições mais vigorosas está uma proibição total do desenvolvimento de superinteligência até que haja consenso científico de que isso possa ser feito com segurança e com uma adesão democrática genuína; desligamentos obrigatórios em sistemas poderosos; e a proibição de arquiteturas capazes de auto-replicação, auto-aperfeiçoamento autônomo ou resistência ao desligamento.

A divulgação da declaração coincide com um período que torna muito mais fácil avaliar a sua urgência. Na última sexta-feira de Fevereiro, o secretário da Defesa, Pete Hegseth, designou a Anthropic — cuja IA já funciona em plataformas militares classificadas — como um “risco da cadeia de abastecimento” depois de a empresa se ter recusado a conceder ao Pentágono o uso ilimitado da sua tecnologia, um rótulo normalmente reservado a empresas com ligações à China. Horas depois, a OpenAI fechou seu próprio acordo com o Departamento de Defesa, um acordo que, segundo especialistas jurídicos, será difícil de aplicar de forma significativa. O que tudo isso revelou é o quão dispendiosa se tornou a inação do Congresso em relação à IA.

Como Dean Ball, membro sénior da Fundação para a Inovação Americana, disse posteriormente ao The New York Times: “Isto não é apenas uma disputa sobre um contrato. Esta é a primeira conversa que tivemos como país sobre o controlo dos sistemas de IA”.

Evento Techcrunch

São Francisco, Califórnia

|

13 a 15 de outubro de 2026

Tegmark buscou uma analogia que a maioria das pessoas consegue entender quando conversamos. “Você nunca precisa se preocupar com a possibilidade de alguma empresa farmacêutica lançar algum outro medicamento que causa danos enormes antes que as pessoas tenham descoberto como torná-lo seguro”, disse ele, “porque o FDA não permitirá que liberem nada até que seja seguro o suficiente”.

As guerras territoriais em Washington raramente geram o tipo de pressão pública que altera as leis. Em vez disso, Tegmark vê a segurança infantil como o ponto de pressão com maior probabilidade de resolver o impasse atual. Na verdade, a declaração apela à obrigatoriedade de testes pré-implantação de produtos de IA — especialmente chatbots e aplicações complementares destinadas a utilizadores mais jovens — cobrindo riscos que incluem o aumento da ideação suicida, a exacerbação de problemas de saúde mental e a manipulação emocional.

“Se algum velho assustador estiver enviando mensagens de texto para uma criança de 11 anos fingindo ser uma menina e tentando persuadir esse menino a cometer suicídio, o cara pode ir para a cadeia por isso”, disse Tegmark. “Já temos leis. É ilegal. Então, por que é diferente se uma máquina faz isso?”

Ele acredita que, uma vez estabelecido o princípio dos testes de pré-lançamento para produtos infantis, o âmbito irá alargar-se quase inevitavelmente. “As pessoas virão e dirão: vamos adicionar alguns outros requisitos. Talvez devêssemos também testar se isso não pode ajudar os terroristas a fabricar armas biológicas. Talvez devêssemos testar para ter certeza de que a superinteligência não tem a capacidade de derrubar o governo dos EUA.”

Não é pouca coisa que o antigo conselheiro de Trump, Steve Bannon, e Susan Rice, Conselheira de Segurança Nacional do Presidente Obama, tenham assinado o mesmo documento – juntamente com o antigo Presidente do Joint Chiefs, Mike Mullen, e líderes religiosos progressistas.

“O que eles concordam, claro, é que são todos humanos”, diz Tegmark. “Se a questão for saber se queremos um futuro para os humanos ou um futuro para as máquinas, é claro que eles estarão do mesmo lado.”