A promessa da Gemini de raciocínio de ponta e integração perfeita na nuvem era boa demais para ser ignorada – ou assim pensei.

No entanto, à medida que o cenário do modelo local mudou com a chegada de pesos pesados como Gemma 4, Qwen3.6 e outros, comecei a me perguntar se realmente preciso continuar com minha assinatura de US$ 20 por mês.

Eu decidi desligar a tomada. Migrei todo o meu fluxo de trabalho diário para uma pilha local executada em meu próprio hardware.

Algumas semanas depois, a assinatura acabou, minha privacidade voltou às minhas mãos e, surpreendentemente, minha produção não caiu nem um pouco.

Veja como construí uma potência local de IA que finalmente fez a nuvem parecer opcional.

Relacionado

Achei um recurso do Gemini tão bom que excluí vários aplicativos

Prepare-se para uma tela inicial mais limpa

Gema 4 E2B e 26B A4B

![]()

![]()

Gemma é essencialmente o irmão de peso aberto do Gemini e, com o lançamento do Gemma 4, a lacuna de desempenho praticamente diminuiu no meu fluxo de trabalho diário.

A beleza do Gemma 4 é que ele não é um modelo que sirva para todos. Para minha configuração, confio em duas versões específicas que atendem a diferentes partes da minha vida: o E2B para meu fluxo de trabalho móvel e o 26B-A4B para trabalho pesado em meu desktop.

O modelo E2B é uma maravilha da engenharia móvel. Se você for um usuário Android, poderá executá-lo totalmente off-line por meio do aplicativo Google AI Edge Gallery. Ele precisa apenas de cerca de 1,5 GB de RAM para funcionar corretamente no seu dispositivo.

Se você deseja redigir rapidamente uma resposta profissional a um cliente sobre um atraso no envio de joias ou resumir um PDF denso, você pode realizar o trabalho mesmo em uma zona morta sem sinal. É bom e rápido o suficiente para lidar com tarefas casuais diárias.

No entanto, quando volto à minha mesa com uma configuração dedicada do Windows, confio no poderoso modelo 26B-A4B. Embora tenha um total de 26 bilhões de parâmetros, ele usa apenas cerca de 3,8 bilhões por token.

Posso alimentá-lo com um PDF de 50 páginas de um novo documento técnico e ele pode resumir seções específicas ou encontrar contradições no documento em tempo real.

Na semana passada, eu estava planejando uma viagem de fim de semana para minha família. Copiei e colei no chat o texto de três sites de hotéis e dois blogs de viagens.

Em vez de rolar para frente e para trás para comparar preços, apenas perguntei ao modelo:

Crie uma tabela comparando esses cinco hotéis com base na distância do lago, opções de café da manhã e se eles possuem área de recreação infantil.

Construiu a mesa perfeitamente em menos de um minuto.

Ao dividir minhas tarefas entre o Edge e o Desktop (via LM Studio), repliquei a experiência do Gemini por US$ 0 por mês.

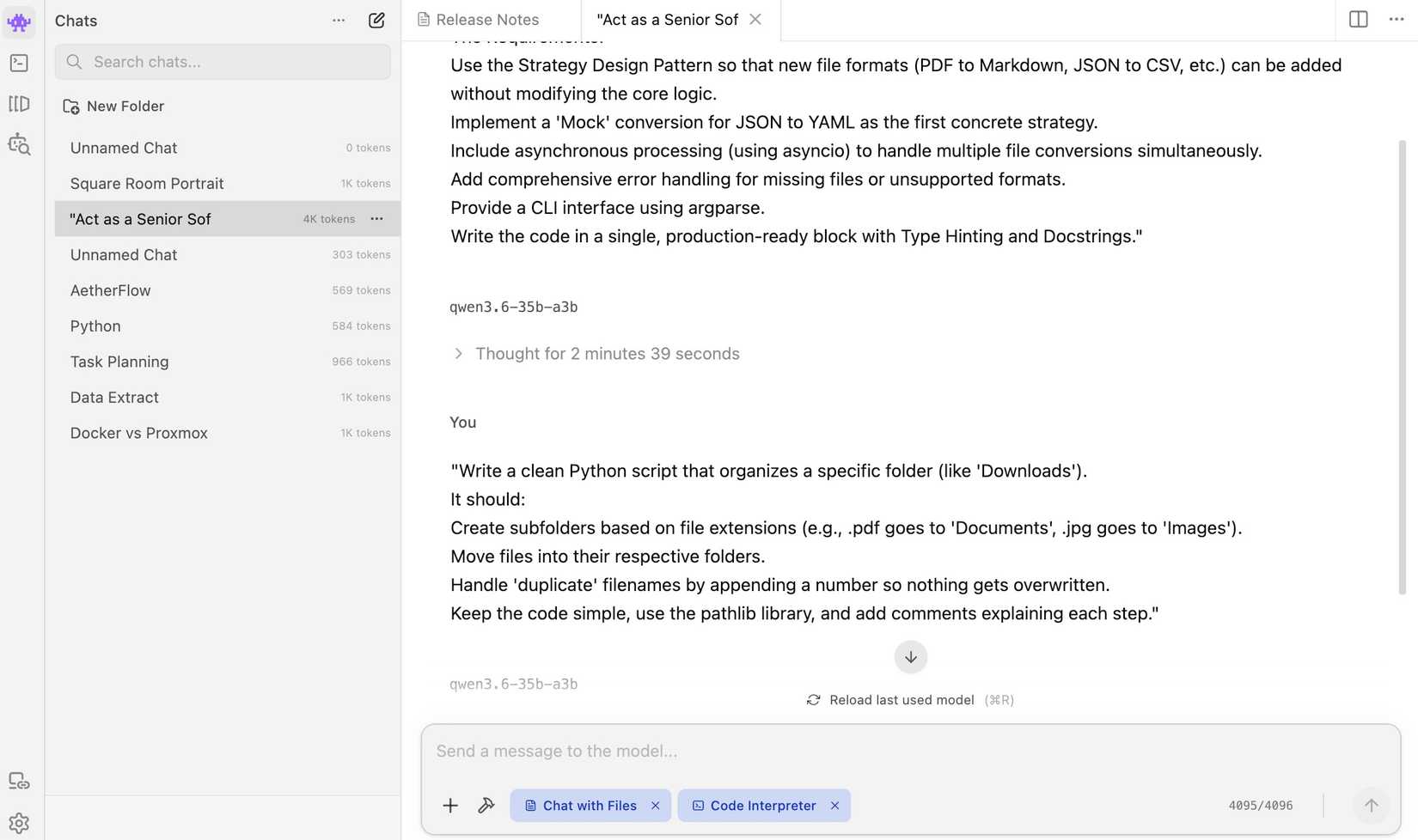

Qwen3.6-27B

Enquanto Gemma cuida do meu raciocínio diário, Qwen3.6-27B é o desenvolvedor sênior da minha equipe local.

Se você é um desenvolvedor que precisa de assistência de codificação de ponta, este é o modelo que finalmente permitirá que você corte o cabo.

A fluência agente é onde o Qwen 3.6 realmente brilha. Ele não apenas sugere a próxima linha de código e encerra o dia. Ele entende o contexto no nível do repositório.

Posso alimentá-lo com vários arquivos de um projeto e ele não esquecerá as funções utilitárias que defini três arquivos atrás.

Costumo usar Qwen como especialista local em Terminal-Bench. Por ser treinado especificamente para trabalho de terminal de agente, é muito bom em automação.

Por ser um modelo 27B, posso executá-lo em velocidades quase instantâneas em meu HP Spectre com uma GPU móvel decente ou em velocidade relâmpago em meu servidor de laboratório doméstico.

Ao usar o LM Studio e transferir as camadas para minha GPU, transformei minha máquina local em uma potência de codificação que rivaliza com tudo o que a nuvem pode oferecer.

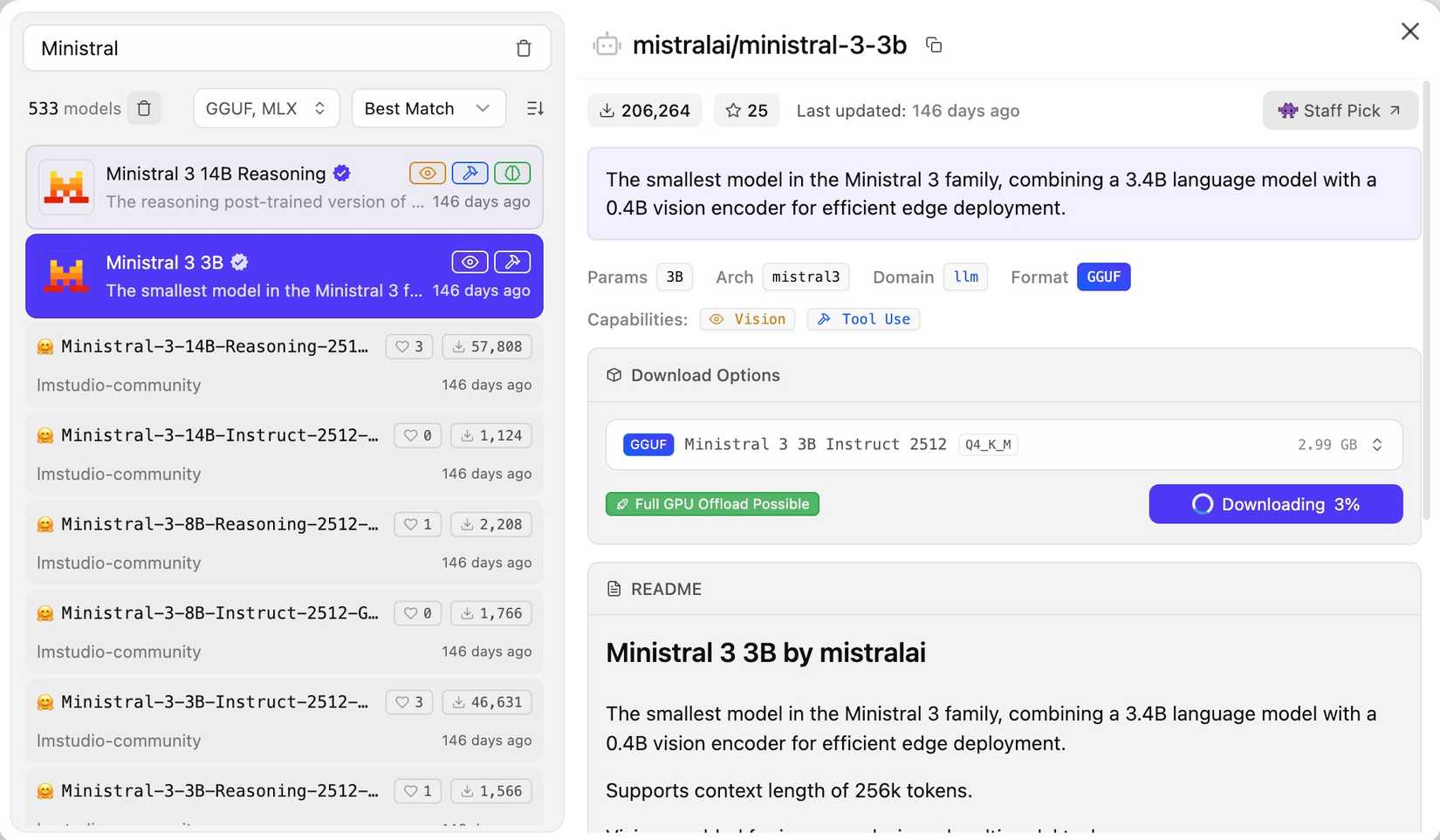

Ministério 3 3B

Se Gemma 4 não funcionar para você, experimente Ministral 3 3B. É outra alternativa de alto desempenho que prova que tamanho não é tudo.

Ele oferece geração de texto quase instantânea que faz com que a IA baseada em nuvem pareça lenta.

A maioria dos modelos começa a perder o controle quando você lhes envia uma longa sequência de mensagens. Ministral 3B mantém uma coerência surpreendente para seu tamanho.

É o modelo que mantenho fixado na barra de tarefas para as centenas de microtarefas que preenchem meu dia.

Além disso, no meu tempo limitado, as respostas parecem mais uma ferramenta e menos uma experiência de palestra.

Ao manter o Ministral 3B como meu assistente sempre ativo, percebi que 90% das minhas necessidades de IA não exigem um gigante de trilhões de parâmetros na nuvem. Eles só precisam de um modelo 3B inteligente, rápido e local que faça o trabalho.

![]()

Relacionado

Achei que o Google Docs era suficiente até combiná-lo com o Gemini

A arma secreta para documentos perfeitos

Produtividade local em primeiro lugar

No geral, abandonar o Google AI Pro acabou sendo uma atualização. Ao mover minhas operações diárias para uma pilha local, criei uma configuração que é mais rápida, mais privada e inteiramente minha.

Agora, a IA local não é mais um compromisso; é uma potência profissional capaz de lidar com tudo, desde codificação complexa até pesquisas profundas. A saída geral e o desempenho dependem inteiramente do hardware que você está usando.

Estas são apenas minhas recomendações pessoais. Você não deve se limitar apenas a esses modelos. Você sempre pode tentar outros LLMs locais que atendam às suas necessidades e configuração de hardware e abandonar esses planos mensais caros para sempre.