O ChatGPT recebe uma atualização de saúde, desta vez para os próprios usuários.

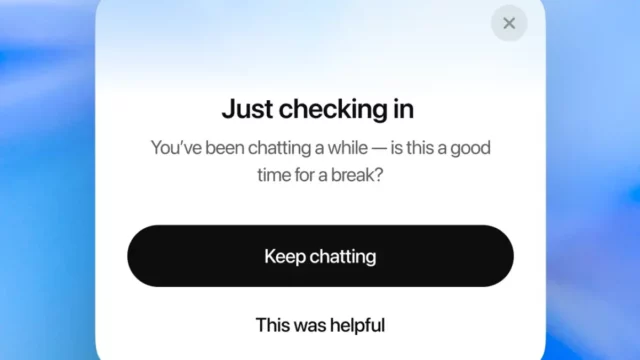

Em uma nova postagem no blog antes do anúncio do GPT-5 relatado da empresa, o Openai revelou que renovaria seu generativo AI-Chatbot com novas funções projetadas para promover relacionamentos mais saudáveis e estáveis entre usuários e ossos. Por exemplo, os usuários que passaram muito tempo em uma conversa agora estão sendo solicitados a se reportar com um impulso suave. A empresa também dobra as soluções para o problema da sycofância do osso e a construção de seus modelos para reconhecer a necessidade mental e emocional.

Veja também:

Um projeto de lei de Illinois que proíbe a terapia de IA é assinado na lei

O ChatGPT responderá de maneira diferente a mais perguntas pessoais de “alta implantação”, explica a empresa, orienta os usuários por meio de tomada de decisão cuidadosa, pesa vantagens e desvantagens e responderá ao feedback em vez de dar respostas a perguntas potencialmente que mudam a vida. O modo de estudo recentemente anunciado do OpenAI do Mirror para ChatGPT, que reclama as respostas diretas e de longo prazo do assistente de IA em favor de lições socráticas guiadas destinadas a incentivar um maior pensamento crítico.

Velocidade de luz mashable

“Nem sempre acertamos. No início deste ano, uma atualização tornou o modelo muito agradável, às vezes dizendo o que parecia bom, em vez do que foi realmente útil. Voltamos de volta, mudamos a maneira como usamos feedback e melhoramos como medimos a usabilidade do mundo real a longo prazo, não apenas se você gostou da resposta no momento”, escreveu o Openai no anúncio. “Também sabemos que a IA pode se sentir mais receptiva e pessoal do que as tecnologias anteriores, especialmente para pessoas vulneráveis que experimentam necessidades mentais ou emocionais”.

Em termos gerais, a OpenAI atualizou seus modelos em resposta às alegações de que seus produtos generativos de IA, em particular, relacionamentos sociais do Chatgpt, e deterioram os distúrbios psicológicos, especialmente entre os adolescentes. No início deste ano, surgiram relatos de que muitos usuários deliberam relacionamentos com o assistente de IA, que deteriorou os distúrbios psiquiátricos existentes, incluindo paranóia e desrealização. Em resposta, as leis mudaram seu foco para regular o uso de chatbot de forma mais intensiva, bem como seu anúncio como parceiros emocionais ou substituições para a terapia.

O OpenAI reconheceu e reconheceu essas críticas de que o modelo 4o anterior “fica aquém” no combate ao comportamento dos usuários. A empresa espera que essas novas funções e os avisos do sistema possam executar o trabalho que falhou em suas versões anteriores.

“Nosso objetivo não é manter sua atenção, mas ajudá -lo a usá -lo bem”, escreve a empresa. “Nós nos apegamos a um teste: se alguém que amamos no ChatGPT usa o suporte, nos sentiríamos tranquilos? É nosso trabalho chegar a um ‘sim’ inequívoco.”