Os pesquisadores da Apple criaram um modelo de IA que reconstrói um objeto 3D a partir de uma única imagem, mantendo reflexos, realces e outros efeitos consistentes em diferentes ângulos de visão. Aqui estão os detalhes.

Um pouco de contexto

Embora o conceito de espaço latente na aprendizagem automática não seja exatamente novo, tornou-se mais popular do que nunca nos últimos anos, com a explosão de modelos de IA baseados na arquitetura do transformador e, mais recentemente, em modelos mundiais.

Resumindo (e correndo o risco de ser um pouco impreciso para explicar o quadro geral), “espaço latente” ou “espaço de incorporação” são termos que descrevem o que acontece quando você:

- Resuma as informações em representações numéricas de seus conceitos;

- Organize esses números em um espaço multidimensional, possibilitando calcular as distâncias entre eles para cada dimensão diferente.

Se isso ainda parece muito abstrato, um exemplo clássico é obter a representação matemática do token “rei”, subtrair a representação matemática do token “homem”, adicionar a representação matemática do token “mulher” e você terminará na região multidimensional geral do token “rainha”.

Em termos práticos, armazenar informações como representações matemáticas no espaço latente torna mais rápido e menos dispendioso computacionalmente medir distâncias entre elas e estimar a probabilidade do que deveria ser gerado.

Aqui está um pequeno vídeo que explica o espaço latente usando uma analogia diferente:

Embora os exemplos acima se concentrem no armazenamento de texto em espaço latente, a mesma ideia pode ser aplicada a muitos outros tipos de dados. O que nos leva ao estudo da Apple.

LiTo: Tokenização de campo de luz de superfície

No novo estudo da Apple, intitulado LiTo: Surface Light Field Tokenization, os pesquisadores “propõem uma representação latente 3D que modela conjuntamente a geometria do objeto e a aparência dependente da visualização”.

Em outras palavras, eles criaram uma forma de representar, no espaço latente, não apenas como reconstruir um objeto tridimensional, mas também como a luz interagindo com ele deveria aparecer de diferentes ângulos.

Como eles explicam:

A maioria dos trabalhos anteriores concentra-se na reconstrução da geometria 3D ou na previsão da aparência difusa independente da visão e, portanto, luta para capturar efeitos realistas dependentes da visão. Nossa abordagem aproveita que as imagens de profundidade RGB fornecem amostras de um campo de luz superficial. Ao codificar subamostras aleatórias deste campo de luz superficial em um conjunto compacto de vetores latentes, nosso modelo aprende a representar a geometria e a aparência dentro de um espaço latente 3D unificado. Esta representação reproduz efeitos dependentes da visualização, como realces especulares e reflexos de Fresnel sob iluminação complexa.

Além do mais, os pesquisadores conseguiram treinar o modelo para que ele pudesse fazer tudo isso a partir de uma única imagem, em vez dos métodos mais comuns que exigem imagens de diferentes ângulos para permitir a reconstrução 3D.

Embora todo o método seja altamente técnico e explicado em detalhes no estudo, a ideia central é relativamente simples, uma vez que você entende como funciona o espaço latente:

- Primeiro, um codificador comprime as informações sobre o objeto em uma representação compacta no espaço latente. Assim, em vez de armazenar todos os detalhes visíveis, aprende uma descrição matemática condensada da forma do objeto e como a luz interage com a sua superfície.

- Então, um decodificador faz o inverso. Ele reconstrói o objeto 3D completo a partir dessa representação compacta, gerando tanto a geometria quanto a representação de como os efeitos de iluminação, como reflexos e realces, devem aparecer em diferentes ângulos de visão.

TreinamentoLiTo

Para treinar o modelo, os pesquisadores selecionaram milhares de objetos renderizados em 150 ângulos de visão diferentes e 3 condições de iluminação.

Então, em vez de alimentar todas essas informações diretamente no modelo, o sistema selecionou aleatoriamente pequenos subconjuntos dessas amostras e os comprimiu em uma representação latente.

Em seguida, o decodificador foi treinado para reconstruir o objeto completo e sua aparência sob diferentes ângulos e condições de luz, apenas a partir desse subconjunto de dados.

Ao longo do treinamento, o sistema aprendeu uma representação latente que capturou tanto a geometria do objeto quanto como sua aparência muda dependendo da direção de visualização.

Feito isso, eles treinaram outro modelo que pega uma única imagem de um objeto e prevê a representação latente que lhe corresponde. Em seguida, o decodificador reconstrói o objeto 3D completo, incluindo como sua aparência muda conforme o ângulo de visão varia.

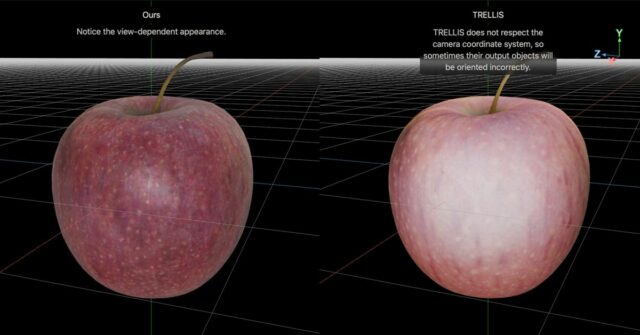

Aqui estão algumas comparações de reconstrução entre LiTo e um modelo chamado TRELLIS, conforme a Apple publicou na página do projeto:

Não deixe de conferir a página do projeto, onde você também pode carregar comparações interativas lado a lado entre LiTo e TRELLIS, como pode ser visto na imagem em destaque deste post.

E para o estudo completo, siga este link.

Vale a pena conferir na Amazon

FTC: Usamos links de afiliados automotivos para geração de renda. Mais.