9to5Mac Security Bite é oferecido exclusivamente a você por Mosyle, a única plataforma unificada da Apple. Tudo o que fazemos é tornar os dispositivos Apple prontos para o trabalho e seguros para a empresa. Nossa abordagem integrada exclusiva para gerenciamento e segurança combina soluções de segurança de última geração específicas da Apple para proteção e conformidade totalmente automatizadas, EDR de última geração, Zero Trust com tecnologia de IA e gerenciamento de privilégios exclusivo com o Apple MDM mais poderoso e moderno do mercado. O resultado é uma plataforma unificada da Apple totalmente automatizada, atualmente confiável por mais de 45.000 organizações para deixar milhões de dispositivos Apple prontos para funcionar sem esforço e a um custo acessível. Solicite seu TESTE ESTENDIDO hoje e entenda por que o Mosyle é tudo que você precisa para trabalhar com a Apple.

Por volta dessa época, há dois anos, a incrivelmente popular API GPT-4 da OpenAI estava se espalhando como um incêndio por toda a App Store. Não demorou muito para que aplicativos de produtividade alimentados por IA, companheiros de chatbot, rastreadores nutricionais e basicamente qualquer outra coisa que você pudesse imaginar dominassem as paradas, obtendo milhões de downloads. Avançando até hoje, muitos desses aplicativos oportunistas e codificados por vibração desapareceram, em parte devido ao entusiasmo esfriante, mas também à postura mais dura da Apple contra imitações e aplicativos enganosos.

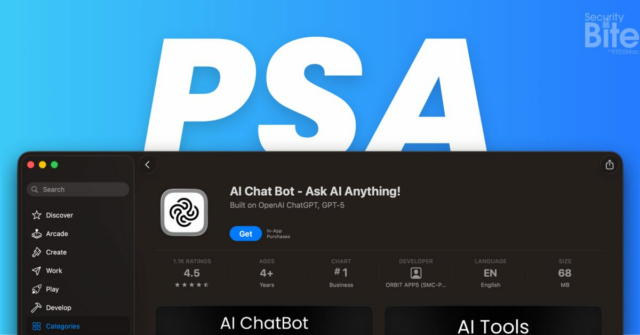

No entanto, esta semana, o pesquisador de segurança Alex Kleber notou que um chatbot de IA enganoso, personificando a marca da OpenAI, conseguiu obter as melhores notas na categoria Negócios. Embora na Mac App Store menos popular, isso ainda é significativo e garante que um PSA seja cauteloso ao compartilhar informações pessoais com esses aplicativos.

O aplicativo comercial “AI ChatBot” número um no macOS parece personificar a marca da OpenAI, desde seu logotipo e nome até seu design e lógica. A investigação mostra que ele é feito pelo mesmo desenvolvedor de outro aplicativo quase idêntico. Ambos compartilham nomes correspondentes, interfaces e capturas de tela idênticas e até mesmo o mesmo site de suporte que leva a uma página gratuita do Google. Eles também aparecem na mesma conta de desenvolvedor e endereço de empresa localizada no Paquistão.

Apesar da remoção pela Apple da maioria dos aplicativos imitadores do OpenAI, esses dois escaparam da análise e agora estão entre os principais downloads na Mac App Store dos EUA.

Nem é preciso dizer que as avaliações, a classificação ou mesmo a aprovação de um aplicativo na loja não garantem necessariamente a segurança em relação à privacidade dos dados.

Clone GPT esboçado na Mac App Store dos EUA – 9to5Mac

Clone GPT esboçado na Mac App Store dos EUA – 9to5Mac

Um relatório recente publicado pela Private Internet Access (PIA) encontrou exemplos preocupantes de fraca transparência em muitas destas aplicações de produtividade pessoal. Um popular assistente de IA que usou a API ChatGPT coletou silenciosamente muito mais dados do usuário do que afirmava a descrição da App Store. A listagem dizia que apenas coletava mensagens e IDs de dispositivos para melhorar a funcionalidade e gerenciar contas. Sua política de privacidade mostrou que ele também coletou nomes, e-mails, estatísticas de uso e informações de dispositivos, que muitas vezes acabam sendo vendidos para corretores de dados ou usados para fins nefastos.

Qualquer aplicativo clone GPT que colete informações de usuários vinculadas a nomes reais é uma receita para o desastre. Imagine um enorme conjunto de conversas onde cada mensagem está ligada à pessoa que a disse, num banco de dados incompleto administrado por uma empresa de fachada com uma política de privacidade gerada por IA que não retém água no país onde reside. Isso está acontecendo em algum lugar agora.

Pode-se presumir que é por isso que a App Store possui rótulos de privacidade. Embora a Apple os tenha introduzido para ajudar os usuários a entender quais dados um aplicativo coleta e como ele os utiliza, esses rótulos são relatados pelos próprios desenvolvedores. A Apple confia em sua honestidade. Os desenvolvedores podem esticar a verdade e a Apple não possui um sistema para verificá-la.

Acho importante continuar divulgando que esses aplicativos ainda estão por aí, coletando sabe-se lá quais informações e dados de usuários desavisados. Estes, sem dúvida, representam enormes riscos de privacidade. Espalhe a palavra!

FTC: Usamos links de afiliados automotivos para geração de renda. Mais.