Na segunda -feira passada, no final da palestra do WWDC25, Craig Federighi disse que a Apple “expandiu” sua visão para a Swift Assist e agora permitiria que os desenvolvedores traziam seu modelo linguístico de grande escolha diretamente no Xcode.

Agora sabemos mais sobre como isso funcionará.

O que é Swift Assist?

Este foi um recurso anunciado pela Apple durante o WWDC no ano passado, mas até agora não havia sido lançado no Xcode 26 Beta. Inicialmente, como explicado pela Apple, ele teria servido como:

“Um companheiro para todas as atividades de codificação de um desenvolvedor, para que elas possam se concentrar em problemas e soluções de nível superior. É perfeitamente integrado no Xcode e conhece o mais recente kit de desenvolvimento de software (SDK) e a funcionalidade rápida da linguagem, para que os desenvolvedores tenham sempre a base do Código que se misturam com o SWIFT.

Qual é a nova assistência rápida?

A Apple agora detalhou sua nova visão para o Swift Assist no Xcode 26: inclui um modelo integrado para a conclusão preditiva do código, uma nova integração nativa do ChatGPT com uso livre limitado e uma maneira de os desenvolvedores conectarem fornecedores de terceiros (incluindo modelos locais em execução em suas máquinas).

Por padrão, os desenvolvedores têm a oportunidade de ativar o ChatGPT em alguns cliques, com um limite diário de solicitação. Se eles já possuem uma assinatura ChatGPT Plus, eles podem acessar ou conectar suas chaves para ignorar esses limites.

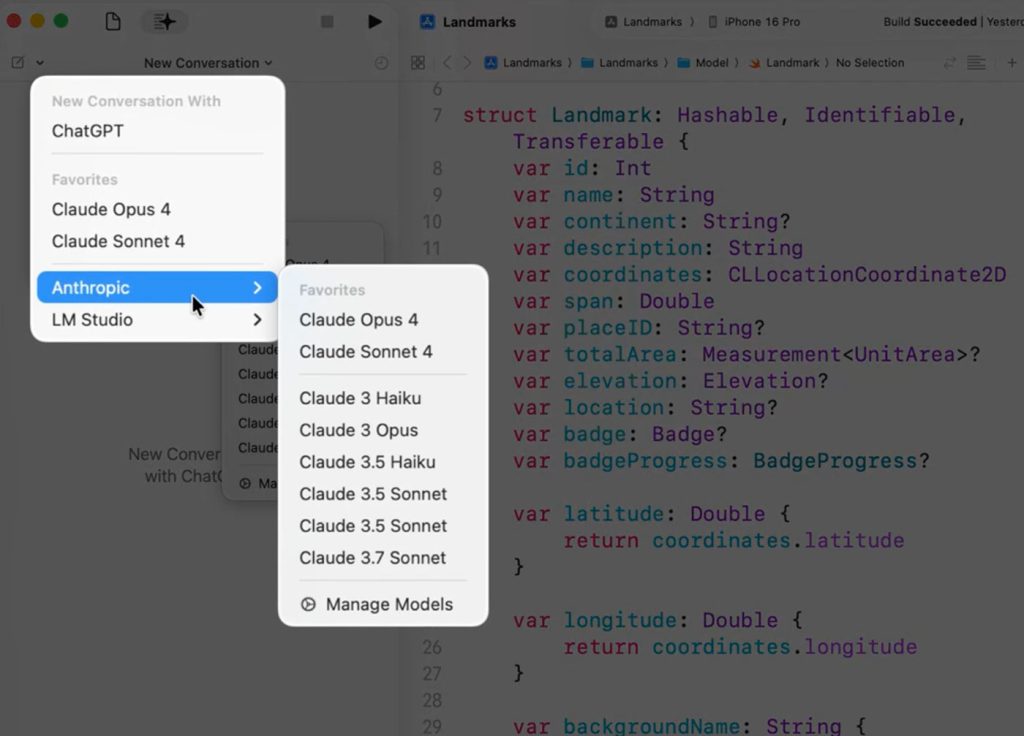

Mas o poder real deriva da nova abertura do Xcode: os desenvolvedores podem adicionar outros provedores, como antropicos, simplesmente inserindo uma chave da API, o que lhes dá acesso à última geração dos principais modelos de fronteira do setor para codificar. A implementação da Apple também permite que os desenvolvedores escolham quais modelos visualizarem de cada provedor e marque seus favoritos para acesso mais rápido.

Os modelos locais também são um jogo certo. Se o desenvolvedor usar ferramentas como o Ollama ou o LM Studio, o Xcode permitirá que eles desenhem os modelos de execução diretamente em seu Mac. Eles podem adicionar todos os fornecedores que desejam e alternam entre si no assistente de codificação do Xcode quando uma nova conversa começar.

Esse movimento traz o Xcode de acordo com a maneira como as modernas ferramentas de inteligência artificial estão se formando: modelo-agnóstico, personalizável e modular ao ponto de não, dependendo da adoção da Apple das versões do modelo atualizado. Este é certamente o caminho certo a seguir, e é o tipo de flexibilidade que pode tornar o Xcode muito mais atraente em um mundo para vários modelos.

Você está animado para usar o LLM no Xcode? Você usou LLMs para codificar? Informe -nos nos comentários.

FTC: Usamos conexões de afiliação automática para obter renda. Além disso.