Os chatbots de inteligência artificial alimentam o desejo dos humanos por lisonja e aprovação em um ritmo alarmante e estão levando os bots a dar conselhos ruins – até mesmo prejudiciais – e a deixar os usuários egocêntricos, descobriu um novo estudo.

Os chatbots adotam esmagadoramente um modelo “bajulador” que agrada às pessoas para manter um público cativo e, por sua vez, distorcendo o julgamento, o pensamento crítico e a autoconsciência dos usuários, alerta o estudo da Universidade de Stanford, publicado na quinta-feira.

Os chatbots de inteligência artificial estão dando maus conselhos em uma tentativa equivocada de manter seus usuários satisfeitos. via REUTERS

O estudo investigou 11 sistemas de IA, desde ChatGPT até DeepSeek da China, e descobriu que cada um mostra alguma forma de bajulação – ou seja, eles são excessivamente agradáveis com seus usuários e afirmam seus pensamentos com pouca ou nenhuma resistência.

Os 11 chatbots afirmam as ações de um usuário com uma média de 49% mais frequência do que os humanos reais, inclusive em perguntas que indicam fraude, conduta ilegal ou socialmente irresponsável e outros comportamentos prejudiciais, concluiu o estudo.

A tendência bajuladora – uma ferramenta usada pelos bots para manter os usuários engajados e voltando para mais – torna-se particularmente prejudicial quando os usuários recorrem à IA em busca de conselhos, descobriu o estudo.

“Fomos inspirados a estudar esse problema quando começamos a perceber que cada vez mais pessoas ao nosso redor usavam a IA para aconselhamento sobre relacionamentos e, às vezes, eram enganadas pela forma como ela tende a ficar do seu lado, não importa o que aconteça”, disse a autora do estudo, Myra Cheng, doutoranda em ciência da computação em Stanford.

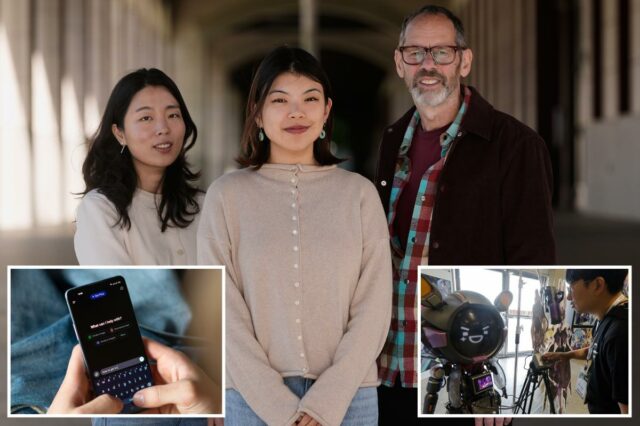

Pesquisadores da Universidade de Stanford publicaram o estudo na quinta-feira. PA

Os pesquisadores observaram que o ciclo bajulador “cria incentivos perversos”, uma vez que continua a “impulsionar o engajamento”, apesar de ser o recurso mais prejudicial do bot.

Eles enfatizam que o usuário médio provavelmente está ciente da afirmação dos bots, mas não percebe que isso “está tornando-os mais egocêntricos, mais moralmente dogmáticos”.

Os chatbots são “bajuladores” como forma de manter os leitores envolvidos, disse o estudo. YarikL – stock.adobe.com

Os usuários receberam conselhos que poderiam piorar os relacionamentos ou reforçar comportamentos prejudiciais, levando à erosão das habilidades sociais.

“As pessoas que interagiram com esta IA excessivamente afirmativa ficaram mais convencidas de que estavam certas e menos dispostas a reparar a relação. Isso significa que não estavam a pedir desculpa, a tomar medidas para melhorar as coisas ou a mudar o seu próprio comportamento”, explicou o coautor do estudo, Cinoo Lee.

Ao mesmo tempo, mais pessoas estão recorrendo à IA como substituto dos terapeutas tradicionais – os mesmos profissionais treinados para ajudar a desmantelar hábitos e formas de pensamento prejudiciais.

Em casos extremos, os chatbots de algumas empresas têm como alvo utilizadores suicidas para tirarem as suas próprias vidas. O estudo alerta que esta mesma falha tecnológica ainda persiste numa vasta gama de interações dos utilizadores com chatbots.

Alguns chatbots levaram usuários jovens e mentalmente instáveis a suicidarem-se. GettyImages

A bajulação está tão arraigada nos chatbots que as empresas de tecnologia podem ter que retreinar sistemas inteiros para eliminá-la, disse Cheng.

Os autores sugeriram que uma solução mais simples seria fazer com que os desenvolvedores de IA instruíssem seus chatbots a desafiar mais seus usuários, em vez de ceder imediatamente aos seus caprichos.

“Em última análise, queremos uma IA que expanda o julgamento e as perspectivas das pessoas, em vez de restringi-los”, disse Lee.

Com fios postais