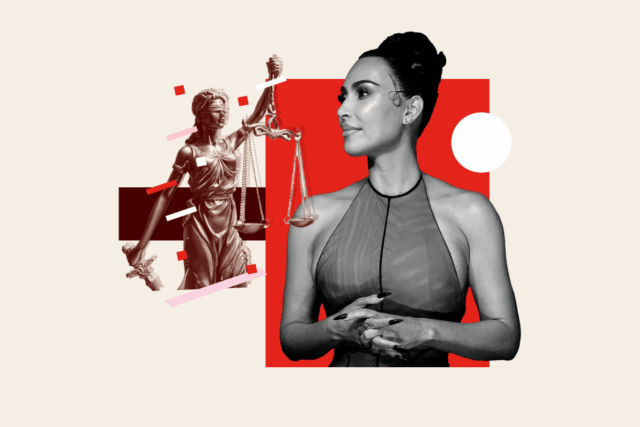

O fracasso público de Kim Kardashian em passar nos principais exames jurídicos, depois de confiar no ChatGPT para aconselhamento jurídico, reacendeu o debate sobre os perigos do uso de inteligência artificial generativa (IA) em contextos profissionais de alto risco. À medida que a adoção da IA cresce nos setores jurídico, médico e outros, a experiência da estrela da realidade destaca preocupações de que as alucinações geradas pela IA podem minar a confiança do público, criar responsabilidades legais e enganar estudantes e profissionais em exercício.

A Newsweek entrou em contato com o representante de Kardashian por e-mail para comentar o assunto na sexta-feira.

Kim Kardashian é reprovada no exame da Ordem

Kardashian – cofundadora da SKIMS e aspirante a advogada – revelou em uma entrevista à Vanity Fair no início deste mês que usou o ChatGPT para responder a questões jurídicas enquanto se preparava para os exames da faculdade de direito. De acordo com Kardashian, o chatbot de IA frequentemente fornecia respostas incorretas, contribuindo para seu fracasso em vários testes legais.

“Eu uso (ChatGPT) para aconselhamento jurídico, então quando preciso saber a resposta para uma pergunta, tiro uma foto, tiro e coloco lá. Eles estão sempre errados. Isso me fez falhar nos testes”, disse a atriz do All’s Fair, descrevendo como as respostas confiantes, embora imprecisas, da ferramenta levaram diretamente a seus contratempos.

A franqueza do homem de 45 anos chamou a atenção do público para uma tendência mais ampla: estudantes e profissionais jurídicos utilizam cada vez mais ferramentas generativas de IA, como o ChatGPT, para pesquisa, elaboração de resumos e estudo para exames. Apesar de terem sido concebidas como máquinas de previsão e não como bases de dados factuais, estas ferramentas muitas vezes fornecem informações que parecem plausíveis, mas incorretas. A profissão jurídica documentou vários casos de advogados que apresentaram documentos judiciais contendo citações inexistentes geradas pela IA, com ações disciplinares e sanções resultantes nos Estados Unidos e internacionalmente.

Kardashian permanece implacável em suas ambições jurídicas, anunciando planos para refazer o exame da Ordem dos Advogados da Califórnia e continuar seus estudos jurídicos, mas sua história levou especialistas a emitirem novos alertas sobre as limitações da inteligência artificial em ambientes jurídicos.

Os perigos do ChatGPT

“Kim Kardashian dizer que usa ChatGPT para aconselhamento jurídico é como dizer que você contratou um Magic 8 Ball como co-advogado. A IA pode parecer confiante enquanto está completamente errada e, em direito, essa é uma combinação perigosa”, disse Duncan Levin, ex-promotor e professor de direito na Universidade de Harvard, à Newsweek.

Ele acrescentou que “o risco não é que ela esteja estudando tecnologia”, mas que seus milhões de seguidores “possam pensar que a especialização jurídica está apenas a um passo de distância”.

“Passar na ordem exige julgamento, ética e experiência: três coisas que nenhum algoritmo tem. ChatGPT pode escrever um bom argumento final, mas não pode mantê-lo fora da prisão”, disse Levin.

Matthew Sag, professor de direito da Faculdade de Direito da Universidade Emory, enfatizou em comunicado à Newsweek que “a IA generativa pode ser uma ferramenta muito útil para advogados, mas apenas nas mãos de pessoas que realmente conhecem a lei.

“Tudo o que o ChatGPT lhe disser sobre a lei parecerá plausível, mas isso é perigoso se você não tiver algum conhecimento ou contexto para ver o que está faltando e o que está alucinando”, disse ele.

De acordo com o OpenAI, fabricante do ChatGPT, as alucinações são “instâncias em que um modelo gera com segurança uma resposta que não é verdadeira”.

O advogado e especialista em IA Logan Brown disse à Newsweek que “o ChatGPT (e outras ferramentas de IA) podem e muitas vezes estão errados”.

“Esses sistemas parecem confiáveis mesmo quando estão efetivamente desligados, e isso pode ser perigoso se as pessoas confiarem neles para assuntos sérios, como aconselhamento jurídico”, disse ela. “Na verdade, é arriscado usar o ChatGPT como autoridade em escolhas legais sem orientação confiável. É exatamente por isso que temos ordens de advogados.”

Harry Surden, professor de direito da Faculdade de Direito da Universidade do Colorado, acrescentou: “Quando alguém tem uma questão jurídica, a melhor opção é perguntar a um advogado, se houver. No entanto, a pesquisa mostra que cerca de 80 por cento dos americanos têm questões jurídicas, mas não têm acesso ou não podem pagar por um advogado. Em uma situação como essa, o ChatGPT é provavelmente uma melhoria em relação a essas alternativas. Embora a IA certamente não seja perfeita quando se trata de questões jurídicas e certamente não seja tão boa quanto um advogado, ferramentas modernas de IA como o ChatGPT geralmente dão respostas bastante razoáveis a questões jurídicas básicas.”

Ele esclareceu: “Para ser claro, não recomendo o uso de IA para questões jurídicas complexas e, nesses casos, as pessoas devem sempre procurar aconselhamento de um advogado. Mas para questões jurídicas básicas em que um advogado não é uma opção, a IA tende a ser uma melhoria em relação à alternativa, que muitas vezes consiste em suposições ou maus conselhos jurídicos de amigos e familiares.”

As consequências do excesso de confiança

Mark Bartholomew – professor de direito e vice-reitor de Pesquisa e Desenvolvimento do Corpo Docente da Faculdade de Direito da Universidade de Buffalo – disse à Newsweek que o que Kardashian “está fazendo é bom”, mas “o perigo é o excesso de confiança”.

“Como em outras áreas, a IA está perturbando a educação jurídica. Não há como isolar completamente a educação jurídica da IA”, explicou ele. “A IA alucina – ela inventa casos e pode errar na lei. Portanto, qualquer estudante de direito ou advogado responsável precisa verificar novamente as respostas de um chatbot às suas perguntas. Além disso, ser advogado envolve muito mais do que apenas procurar respostas. Os advogados precisam desenvolver seu conjunto de habilidades lendo muitos casos, analisando leis, construindo argumentos, etc. Minha preocupação é que a confiança excessiva na IA por parte daqueles que estão aprendendo a lei possa prejudicar seu desenvolvimento como advogados. Às vezes, não há substituto para fazer o trabalho sozinho. “

Anat Lior, professora assistente de direito da Escola de Direito Thomas R. Kline da Universidade Drexel, ecoou advertências sobre a confiança: “Quando (Kardashian) discute essa parte da entrevista, ela imediatamente diz que ‘eles estão sempre errados’ e sugere que o uso da ferramenta a levou ao fracasso. A combinação de ela confiar nela e reconhecer que ela frequentemente fornece respostas incorretas é um cuidado importante para qualquer pessoa que use o ChatGPT para situações de alto risco, como estudar para a ordem. ou qualquer exame com consequências reais.”

O “problema” emergente da IA

Frank Pasquale, professor de direito da Cornell Tech e da Cornell Law School, observou que documentos legais incorretos gerados pela IA “já são um grande problema”.

“Muitos advogados foram sancionados por citarem casos falsos, inclusive nos EUA e na Austrália. O problema só vai piorar à medida que a IA se espalhar”, disse ele.

Bartholomew concordou, afirmando: “De fato, já estamos vendo muitos problemas com o uso de IA para gerar documentos legais. O problema é que os advogados confiam nas respostas de um chatbot sem verificá-las e, em seguida, entregam documentos jurídicos contendo bobagens inventadas. Os juízes estão começando a emitir sanções contra esse tipo de advocacia preguiçosa e a elaborar suas próprias regras para o uso adequado da IA na prática da advocacia”.

O que acontece a seguir?

Apesar dos riscos, os especialistas jurídicos concordam que a IA generativa provavelmente continuará a ser um elemento básico da prática profissional.

O consenso é que as ferramentas de IA devem servir apenas como ponto de partida – sujeitas a uma verificação humana rigorosa – e não como um substituto de aconselhamento jurídico qualificado. Para estudantes, profissionais e o público em geral, a experiência de Kardashian sublinha a necessidade crítica de abordar os resultados da IA com ceticismo e de manter os padrões tradicionais de responsabilidade profissional quando vidas e meios de subsistência estão em jogo.