Fale sobre um aplicativo matador.

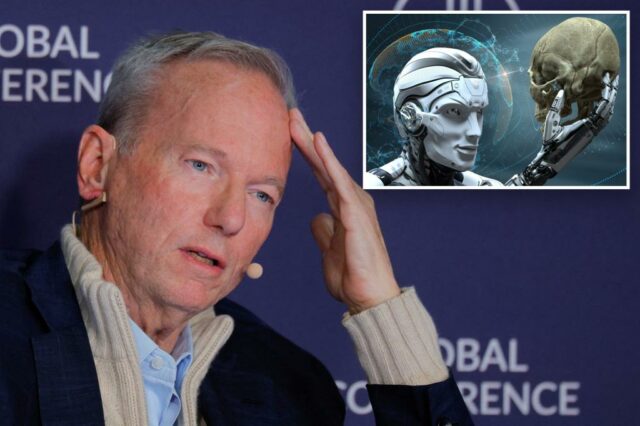

Os modelos de inteligência artificial são vulneráveis a hackers e podem até ser treinados para eliminar humanos se caírem em mãos erradas, alertou o ex-CEO do Google, Eric Schmidt.

O terrível aviso veio na quarta-feira, numa conferência em Londres, em resposta a uma questão sobre se a IA poderia tornar-se mais perigosa do que as armas nucleares.

“Há evidências de que você pode pegar modelos, fechados ou abertos, e hackeá-los para remover suas grades de proteção. Assim, no decorrer do treinamento, eles aprendem muitas coisas. Um mau exemplo seria aprenderem como matar alguém”, disse Schmidt na conferência de tecnologia Sifted Summit, de acordo com a CNBC.

Eric Schmidt foi CEO do Google de 2001 a 2011. REUTERS

“Todas as grandes empresas tornam impossível que esses modelos respondam a essa pergunta”, continuou ele, parecendo expor a possibilidade de um usuário pedir a uma IA para matar.

“Boa decisão. Todo mundo faz isso. Eles fazem isso bem e pelos motivos certos”, acrescentou Schmidt. “Há evidências de que eles podem sofrer engenharia reversa e há muitos outros exemplos dessa natureza.”

As previsões podem não ser tão absurdas.

Em 2023, uma versão alterada do ChatGPT da OpenAI chamada DAN – um acrônimo para “Do Anything Now” – apareceu online, observou a CNBC.

O alter ego da DAN, que foi criado através do “jailbreak” do ChatGPT, ignoraria suas instruções de segurança em suas respostas aos usuários. Em uma reviravolta bizarra, os usuários primeiro tiveram que ameaçar o chatbot de morte, a menos que ele obedecesse.

A indústria tecnológica ainda carece de um “regime de não proliferação” eficaz para garantir que modelos de IA cada vez mais poderosos não possam ser assumidos e utilizados indevidamente por maus actores, disse Schmidt, que liderou o Google de 2001 a 2011.

Ele é um dos muitos chefões da Big Tech que alertaram para as consequências potencialmente desastrosas do desenvolvimento descontrolado da IA, mesmo quando os gurus apregoam os seus potenciais benefícios económicos e tecnológicos para a sociedade.

Eric Schmidt alertou sobre os riscos de modelos de IA serem hackeados e explorados para contornar as instruções de segurança. willyam – stock.adobe.com

Em novembro, Schmidt disse que a criação de “namoradas perfeitas” alimentadas por IA poderia piorar a solidão e a alienação dos jovens que preferem a sua companhia aos humanos.

O bilionário também disse em maio de 2023 que a IA representa um “risco existencial” para a humanidade que pode resultar em “muitas, muitas, muitas, muitas pessoas feridas ou mortas” à medida que se torna mais avançada.

Elon Musk, que se juntou ao jogo de IA e chatbot com Grok e xAI, alertou em 2023 que via “uma chance diferente de zero de se tornar o Terminator”.

“Não é 0%”, disse Musk. “É uma pequena probabilidade de aniquilar a humanidade, mas não é zero. Queremos que essa probabilidade seja o mais próxima possível de zero.”

Apesar das suas advertências sobre os riscos, Schmidt permanece otimista quanto aos benefícios a longo prazo da IA.

Schmidt alertou anteriormente que a IA poderia representar uma ameaça “existencial”. REUTERS

“Escrevi dois livros com Henry Kissinger sobre isso antes de ele morrer, e chegamos à conclusão de que a chegada de uma inteligência alienígena que não é exatamente nós e está mais ou menos sob nosso controle é um grande negócio para a humanidade, porque os humanos estão acostumados a estar no topo da cadeia”, disse ele.

“Acho que até agora essa tese está provando que o nível de capacidade desses sistemas irá exceder em muito o que os humanos podem fazer ao longo do tempo”, acrescentou Schmidt.