A chegada da inteligência artificial já teve um impacto transformador na sociedade e os especialistas dizem que é apenas o começo. Mas com o progresso surge uma desvantagem inevitável, à medida que a revolução tecnológica ameaça algo que os americanos há muito valorizam e protegem ferozmente: a privacidade.

Vários incidentes recentes de grande repercussão sublinham a intersecção volátil onde o avanço digital e a privacidade colidem agora.

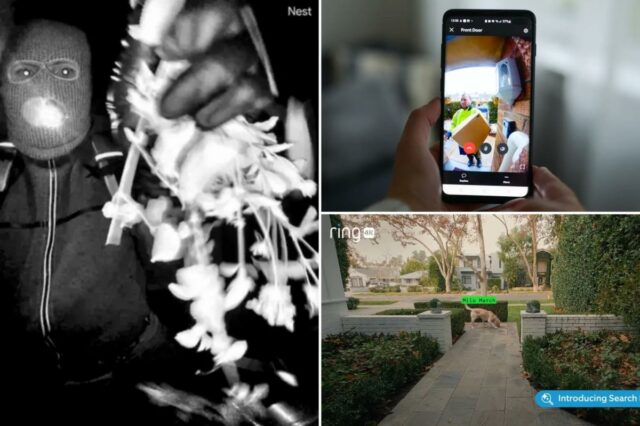

Ring, a empresa de câmeras para campainhas de propriedade da Amazon, enfrentou uma enorme reação após seu desastroso anúncio no Super Bowl, que deveria ser uma celebração da tecnologia da empresa ser responsável por rastrear e encontrar um cachorro perdido. Em vez disso, provocou a indignação dos telespectadores e dos defensores da privacidade, que a viam como um prenúncio de uma rede de vigilância alimentada por IA que poderia ser explorada pelas autoridades policiais e pelos interesses empresariais.

Muitos ficaram confusos quando o FBI conseguiu recuperar imagens da câmera Nest da noite em que Nancy Guthrie foi aparentemente sequestrada de sua casa em Tucson, Arizona, depois que a polícia disse que os dados estavam inacessíveis porque a família não tinha uma assinatura paga. FBI

O CEO da empresa pediu desculpas pela vasta rede de câmeras da Ring e por suas capacidades, embora o monitoramento de casas e bairros seja todo o seu modelo de negócios.

Como resultado, a Ring cancelou sua parceria com a Flock Safety, uma empresa de software de segurança que vende tecnologia de digitalização de placas para autoridades policiais.

Enquanto isso, a OpenAI, empresa por trás do ChatGPT, foi criticada depois que foi revelado que funcionários haviam banido a conta do acusado de atirar em uma escola canadense, Jesse Van Rootselaar, por causa de mensagens perturbadoras – mas nunca alertaram a polícia.

As câmeras da campainha não vigiam apenas os piratas da varanda; eles podem pegar seu vizinho cortando a grama ou caminhando velozmente em frente à sua casa, ou servir como cão de guarda da vizinhança.

Os chatbots de IA fornecem respostas para qualquer pergunta que você tenha em um instante, e todos os dados pessoais acabam em um farm de servidores em algum lugar.

O discurso de vendas é tranquilo, mas o custo real – sua privacidade – pode ser maior do que você gostaria de pagar.

O anúncio do anel “Search Party” que foi ao ar durante o Super Bowl gerou grande reação. Tratava-se de vizinhos ajudando a rastrear um cachorro perdido usando imagens de câmeras externas, mas os detratores disseram que isso levantava questões preocupantes sobre privacidade. Anel

“Isso é realmente assustador para mim”, diz Matt Sailor, CEO da empresa de soluções de vigilância IC Realtime. “Você vai permitir que as empresas usem os dados que estão sendo registrados e arquivados em sua casa com sua família envolvida, sem se importar com o assunto, e meio que façam isso sob o pretexto de ‘ah, estamos fazendo isso para salvar Fido.’ É simplesmente errado.”

“Estamos definitivamente numa fase em que temos de começar a redefinir as nossas expectativas sobre o que é privado”, acrescenta Michel Paradis, advogado que ministra um curso na Universidade de Columbia sobre Direito da Inteligência Artificial.

“E também precisamos ser muito cautelosos.”

No papel, os americanos nunca estiveram tão protegidos.

Na prática, dizem os especialistas, o sistema é uma piada.

As câmeras da campainha não vigiam apenas os piratas da varanda; eles podem pegar seu vizinho cortando a grama ou caminhando velozmente em frente à sua casa, ou servir como cão de guarda da vizinhança. Inga – stock.adobe.com

“Neste momento, as leis que temos baseiam-se essencialmente no funcionamento de uma ligação dial-up num mundo 5G”, diz Paul Armstrong, consultor tecnológico e fundador do Grupo TBD.

A Meta pagou recentemente uma multa de US$ 725 milhões para resolver alegações de violação de privacidade, mas para uma empresa tão grande, esse é simplesmente o custo de fazer negócios.

“Multas como essa são como afirmações para essas grandes empresas de tecnologia”, diz Sree Sreenivasan, CEO da Digi Mentors. “Isso mostra que eles estão no caminho certo com tudo isso.”

“Uma multa de nove dígitos parece enorme até você perceber que o número parece um erro de arredondamento em uma divulgação de lucros trimestrais”, acrescenta Armstrong.

Peter Jackson, advogado de segurança cibernética e privacidade da Greenberg Glusker em Los Angeles, diz que a maioria dos consumidores não tem ideia de quão expostos estão realmente.

A OpenAI baniu a conta de Jesse Van Rootselaar por causa de mensagens perturbadoras antes do atirador matar oito pessoas em Tumbler Ridge, BC, Canadá, – mas a empresa não alertou a polícia. via REUTERS

“Os consumidores estão mal informados sobre o que está acontecendo com suas informações”, diz ele. “As divulgações (de privacidade) são tecnicamente completas e praticamente inúteis. A maioria das pessoas não entende realmente o que isso significa.”

Jackson concorda que as penalidades atuais não atendem ao momento.

Ele aponta para um caso recente em que a The Walt Disney Co. concordou em pagar US$ 2,75 milhões para resolver que violava as leis de privacidade do consumidor da Califórnia.

A gigante do entretenimento foi acusada de não atender integralmente aos pedidos dos usuários para cancelar o compartilhamento de dados nos serviços de streaming da Disney.

O paradeiro de uma pessoa capturado por uma câmera Ring pode ser usado para construir um processo judicial contra ela. WSYX

A multa é um recorde ao abrigo da lei de privacidade da Califórnia, mas, como observa Jackson, “Esse montante não representa nada para a Disney. A lei de privacidade dos EUA não está suficientemente armada com sanções suficientemente fortes para incentivar as empresas a fazerem melhor”.

“A erosão da privacidade não é um bug, mas uma característica do modelo de negócios da maioria das empresas de tecnologia”, diz Arash Vakil, professor de negócios na CUNY e consultor de produtos.

“Essas empresas que possuem um modelo de assinatura integrado poderão ter uma oportunidade melhor de maximizar a receita e o valor para os acionistas.”

“A realidade é que estas empresas vivem de dados”, acrescenta Sailor.

“Eles vivem das informações que você lhes fornece. Eles estão coletando uma quantidade incrível de informações de seus hábitos diários, e seus dados não são realmente seus. As empresas são proprietárias deles.”

Nesta foto, Travis Decker é visto no dia em que pegou suas três filhas em Wenatchee, Washington – a última vez que foram vistas vivas. Os corpos da menina foram descobertos posteriormente na caminhonete de seu pai, desencadeando uma caçada humana. O corpo de Decker foi encontrado meses depois. Gabinete do Xerife do Condado de Chelan

A julgar pela popularidade das câmeras de campainha e dos motores de IA, os consumidores parecem estar satisfeitos com esse resultado. “As pessoas são realmente preguiçosas e sempre escolhem o caminho mais fácil”, diz Sailor.

Muitos ficaram confusos quando o FBI conseguiu recuperar imagens da câmera Nest da noite em que Nancy Guthrie, mãe da co-apresentadora do Today, Savannah Guthrie, foi aparentemente sequestrada de sua casa em Tucson, Arizona, depois que a polícia disse que os dados eram inacessíveis porque a família não tinha uma assinatura paga.

Dias depois, o diretor do FBI, Kash Patel, disse que o vídeo da casa foi “recuperado de dados residuais localizados em sistemas back-end”.

O Google, empresa controladora da Nest, não tem obrigação de reter esses dados se o usuário tiver uma assinatura, e eles podem ser substituídos em algum momento, embora não esteja claro quando isso normalmente acontece. A política de privacidade da empresa observa que o vídeo expira após três horas.

Jaron Mink, professor assistente de ciência da computação e engenharia na Arizona State University, aponta que os EUA têm regulamentações de privacidade frouxas, de acordo com a NPR.

Ladrões de Halloween foram identificados com esta filmagem de câmera de segurança. WUSA9

“Às vezes, isso significa que é mais difícil que a funcionalidade de exclusão de dados realmente ocorra, porque ela não foi criada como um requisito do sistema em mente”, disse Mink.

Embora o Google tenha negado que incorpora o vídeo do usuário Nest para treinar modelos de IA, de acordo com a Ars Technica, ele disse: “Podemos usar suas entradas, incluindo prompts e feedback, uso e resultados de interações com recursos de IA para pesquisas adicionais, ajustar e treinar os modelos generativos, tecnologias de aprendizado de máquina e produtos e serviços relacionados do Google.

Sreenivasan, ex-diretor digital da cidade de Nova York, diz que a maioria dos americanos fez as pazes com a negociação de privacidade por conveniência e uma sensação de segurança.

“Com certeza foi isso que aconteceu. As pessoas têm uma relação estranha com a tecnologia”, diz ele.

Os críticos dizem que as pessoas trocaram privacidade por conveniência com tecnologias como a câmera Ring. Nick Beer – stock.adobe.com

“Eles querem toda a conveniência e toda a privacidade, mas não fazem nada em relação à privacidade e fazem tudo em relação à conveniência.”

O padrão começou muito antes da IA, com cookies – aqueles pequenos arquivos de texto armazenados por sites para lembrar seu login e preferências.

“Quando os cookies surgiram pela primeira vez, os americanos disseram: ‘Sim, tanto faz’”, diz Sreenivasan. “Você aceitou tudo e não se importou, porque queria comodidade. Se você parasse de aceitar cookies, ele não se lembraria da sua conta, não se lembraria dos seus favoritos, não se lembraria do seu histórico. Isso tornaria as compras online uma experiência terrível.”

Depois veio o Gmail em 2005, prometendo “mensagens ilimitadas, sem necessidade de excluir nada”, lembra Sreenivasan. “Sabíamos imediatamente que eles estavam escaneando seus e-mails e exibindo anúncios. Se minha esposa me escrevesse: ‘Querido, você pode comprar um pouco de leite?’ Eu conseguiria um anúncio do Gristedes.”

Nesta filmagem, um trabalhador da Amazon foi visto pegando o gato de alguém. Diane Huff-Medina via Storyful

Vakil vê o mesmo padrão agora com IA, câmeras e aplicativos. “Os usuários ou consumidores têm negociado com muita alegria coisas gratuitas por seus dados”, diz ele. “Nós meio que nos acostumamos com a conveniência que essa tecnologia oferece… mas é preciso lembrar: se o produto é gratuito, então você é o produto.”

Mas outros pensam que os consumidores estão numa posição impossível. “As pessoas nunca tiveram a opção genuína de aceitar esses termos ou não usar o produto”, diz Armstrong. “Cada vez mais optar por sair significa optar por sair da vida moderna.”

A tecnologia sempre cria novas oportunidades para invasões de privacidade.

O que diferencia um chatbot de IA do Google é que ele não apenas exibe links; ele responde. “Os chatbots de IA têm um tipo de personalidade que os faz sentir muito mais como confidentes”, diz Paradis. “Há uma personalidade que está impulsionando essas respostas.”

Essa “intimidade da experiência do chatbot”, diz ele, “levanta muitas questões sobre privacidade… e como o que as pessoas perguntam aos chatbots de IA pode potencialmente ser usado contra elas, seja pelas autoridades policiais ou mesmo apenas socialmente”.

Tem todas as características de um relacionamento confidencial – exceto que não é. “Legalmente, não há nenhuma razão para que qualquer coisa que você coloque em um chatbot seja considerada outra coisa senão o tipo de informação que você daria a um banco”, diz Paradis, observando que os bancos podem ser forçados por ordem judicial a entregar registros de clientes.

Imagens da câmera mostraram dois policiais em um prédio de apartamentos no Bronx pouco antes de um deles atirar em um inquilino embriagado. Juan Rivera

Que responsabilidade têm as empresas tecnológicas quando as suas ferramentas enfrentam a violência no mundo real? Após o tiroteio de 10 de fevereiro na Colúmbia Britânica, a OpenAI prometeu revisar seus protocolos de segurança. Mas será que medidas mais proactivas arriscariam um pesadelo diferente – um mundo de “Relatório da Minoria” onde as pessoas são punidas pelo que podem fazer?

“A situação do ChatGPT com o atirador canadense expõe um cenário sem saída para o qual ninguém legislou ainda”, diz Armstrong.

“Deixar de denunciar significa cumplicidade, mas denunciar significa construir um aparato de vigilância capaz de sinalizar alguém por um pensamento.”

Paradis concorda que é uma área legal cinzenta.

“Nos primeiros dias do Google, as pessoas perguntavam se o Google deveria denunciar à polícia se você estivesse invulgarmente interessado no ISIS com base no seu histórico de pesquisa”, observa ele. “Com a IA, você não está apenas procurando como comprar um silenciador. Você está pedindo que ela explique como usá-lo e como instalá-lo.”

Também não esperem que os legisladores em Washington resolvam isto.

“Certamente, no nível federal, acho que isso será muito improvável”, diz Paradis sobre uma legislação mais rígida sobre IA.

Nos próximos anos, ele espera que ações mais reais ocorram em nível estadual. A administração Trump adoptou “uma visão geralmente libertária”, observa ele, chegando mesmo a pressionar as agências, através de ordem executiva, a procurarem formas de se anteciparem às regulamentações estatais sobre IA.

“Estamos numa espécie de Velho Oeste digital”, diz Jackson. “Nosso sistema jurídico em seu estado atual não foi construído para travar tais batalhas.”

Paradis está cautelosamente otimista de que eventualmente iremos nos adaptar, como fizemos com as tecnologias disruptivas do passado. “Esta não é a primeira grande tecnologia que criou enormes perturbações no nosso sentido de privacidade”, diz ele, apontando para as câmaras e o rádio, outrora vistos como aterradores. “Ficamos mais espertos em relação a isso. E acho que o mesmo acontecerá agora.”