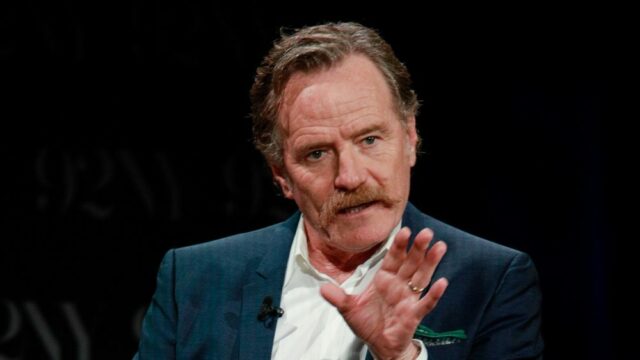

OpenAI parece ter realmente relaxado as ansiedades em torno de Sora 2, ganhando SAG-AFTRA, CAA, UTA e a estrela Bryan Cranston com novas grades de proteção no sistema para proteger as vozes e semelhanças das estrelas.

. Cranston foi um dos que levantaram problemas quando o lançamento inicial do sistema de vídeo AI permitiu que os usuários produzissem sua foto sem seu consentimento. Em uma declaração fornecida pelo sindicato das estrelas na segunda-feira, Cranston agradeceu à OpenAI por atualizar o Sora 2 para incluir defesas totalmente novas.

. “Fiquei profundamente preocupado não apenas comigo, mas também com todos os artistas cujo trabalho e identidade podem ser maltratados ao fazer isso”, afirmou Cranston. “Sou grato à OpenAI por seu plano e por impulsionar suas proteções, e realmente espero que eles e todas as empresas associadas a este trabalho considerem nosso direito individual e especializado de lidar com a duplicação de nossa voz e semelhança.”.

. CAA e UTA foram pioneiros no desenvolvimento de sistemas de alarme relacionados ao Sora 2 no início deste mês, quando o lançamento inicial permitiu aos usuários produzir vídeos de IA usando personalidades protegidas por direitos autorais. Desde então, a OpenAI permaneceu no ambiente de solução de problemas e colaborou com as partes interessadas do mercado para tentar reparar a situação.

. A SAG-AFTRA e as empresas tiveram em mente que a empresa realmente participou de uma “cooperação eficiente” para salvaguardar as liberdades civis das estrelas. Numa declaração, Sean Astin, o novo chefe de estado do sindicato, manteve em mente que as estrelas enfrentam uma ameaça de “apropriação indébita substancial” da IA.

. “Bryan fez a coisa certa ao entrar em contato com seu sindicato e seus representantes especializados para resolver o problema”, afirmou Astin. “Esta determinada situação tem uma resolução favorável. Alegro-me que a OpenAI tenha realmente se dedicado a utilizar um procedimento opt-in, onde todos os músicos têm a capacidade de escolher se desejam aderir à exploração da sua voz e semelhança através da IA”.

. A OpenAI recomendou anteriormente o No Fakes Act, uma regulamentação governamental que certamente proibiria reproduções eletrônicas não consensuais. Na verdade, o SAG-AFTRA fez com que esse regulamento fosse uma das suas maiores prioridades jurídicas possíveis. De acordo com a regulamentação existente, as estrelas têm voz e defesas de semelhança no Estado Dourado e em vários outros estados, mas fora do nível governamental.

. “A OpenAI está profundamente empenhada em proteger os artistas da apropriação indevida de sua voz e semelhança”, afirmou Sam Altman, o CEO, na declaração conjunta na segunda-feira. “Fomos fãs desde muito cedo da Lei NO FAKES, quando esta foi apresentada em 2014, e certamente garantiremos constantemente as liberdades civis dos artistas.”

. Sora 2 permite que os artistas “decidam” que suas semelhanças sejam utilizadas no sistema. Mas o lançamento inicial permitiu aos usuários ajustar as imagens de estrelas que ainda não haviam entrado – aumentando a ansiedade de que o sistema fosse funcionalmente uma “extração”. Altman afirmou mais tarde que a OpenAI estava ajustando o sistema para fornecer aos proprietários de direitos autorais e artistas maior controle sobre como exatamente suas imagens são usadas.

.

Fuente