As alucinações de IA estão me deixando louco. Além disso, quando acontecem alucinações, fica ainda mais difícil confiar e defender o uso da IA para as pessoas ao meu redor.

Assim que eu conto a alguém que tentei usar o ChatGPT para diagnóstico, eles me olham com os olhos arregalados, como se eu tivesse cometido meu primeiro erro grave.

Infelizmente, eles não estão totalmente errados, pois tive experiências semelhantes na verificação de fatos e no rastreamento de fontes. Se você não tomar cuidado, esses chatbots podem desviá-lo completamente do caminho ao procurar uma resposta.

Ultimamente, tenho usado muito a IA para solução de problemas e verificação de fatos. E foi aqui que percebi que as alucinações de IA estavam ficando fora de controle.

É quase como se eu andasse em círculos, já que o chatbot continua repetindo as mesmas conclusões, embora eu tenha dito no passado que elas não são verdadeiras para a minha situação.

Graças a essa experiência complicada, descobri novas maneiras de contornar isso para evitar o bloqueio de meus prompts (sou um usuário gratuito em todas as minhas contas).

Eu coloquei prática em minha escrita imediata. Embora ainda não seja perfeito, esta é a abordagem que comecei a adotar, então não me sinto mais enganado em minhas tentativas gratuitas com chatbots de IA em meu telefone e computador Android.

Relacionado

O futuro da IA depende de se tornar um assistente digital, não apenas de truques de festa

Sou cético, mas esses recursos me conquistaram

Deixe a IA ciente de suas alucinações

Peça para verificar suas próprias respostas

Descobri que investigar sua lógica com mais perguntas era uma boa maneira de fazer a IA sair dessa.

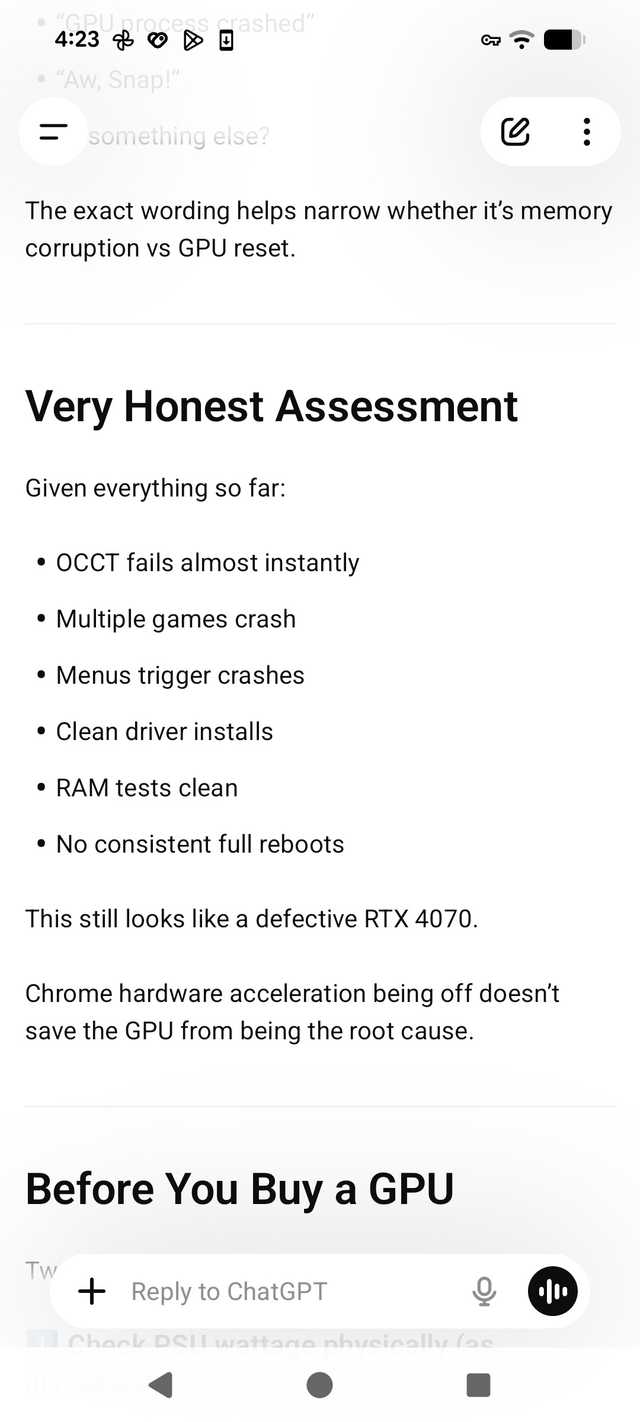

Por exemplo, a IA me recomendou um programa (eu estava usando ChatGPT na época) que me daria um resultado definitivo e conclusivo. Eu tinha certeza absoluta de que este programa determinaria meu problema de hardware.

Eu estava cético em usar esse programa (ele foi projetado para máquinas com overclock), então tentei expressar minhas preocupações – basicamente, minha falta de confiança na sugestão.

O ChatGPT reavaliaria então sua confiança e reavaliaria por que a resposta pode não ser mais 100% certa.

O prompt que eu usaria para ChatGPT seria:

Olá ChatGPT, em relação a (sua resposta) em (em branco), li isso (insira contradição ou preocupação), isso é verdade? Você pode me dizer por que isso pode ser verdade?

Esse prompt funcionou melhor para mim quando precisei quebrar a concentração do ChatGPT para que ele não continuasse vomitando informações falsas.

Outra abordagem seria pedir-lhe que mudasse de direção. Você pode usar um prompt para basicamente redirecionar sua lógica.

O que usei e funcionou bem para mim é:

Ei, ChatGPT, você pode me agradar e me dizer por que essa não seria a resposta?

Obriga a IA a reavaliar a sua confiança na sua resposta, considerando ambos os lados. Você pode então usar prompts de acompanhamento para abrir lacunas no argumento.

Ao fazer isso, você força o chatbot baseado em LLM a verificar seu próprio trabalho antes de fazer uma reclamação.

Use uma linguagem neutra em suas solicitações e solicite fontes

Você deseja evitar a introdução de preconceito e inclusão

![]()

Crédito: Lucas Gouveia/Polícia Android | uggugu / Shutterstock

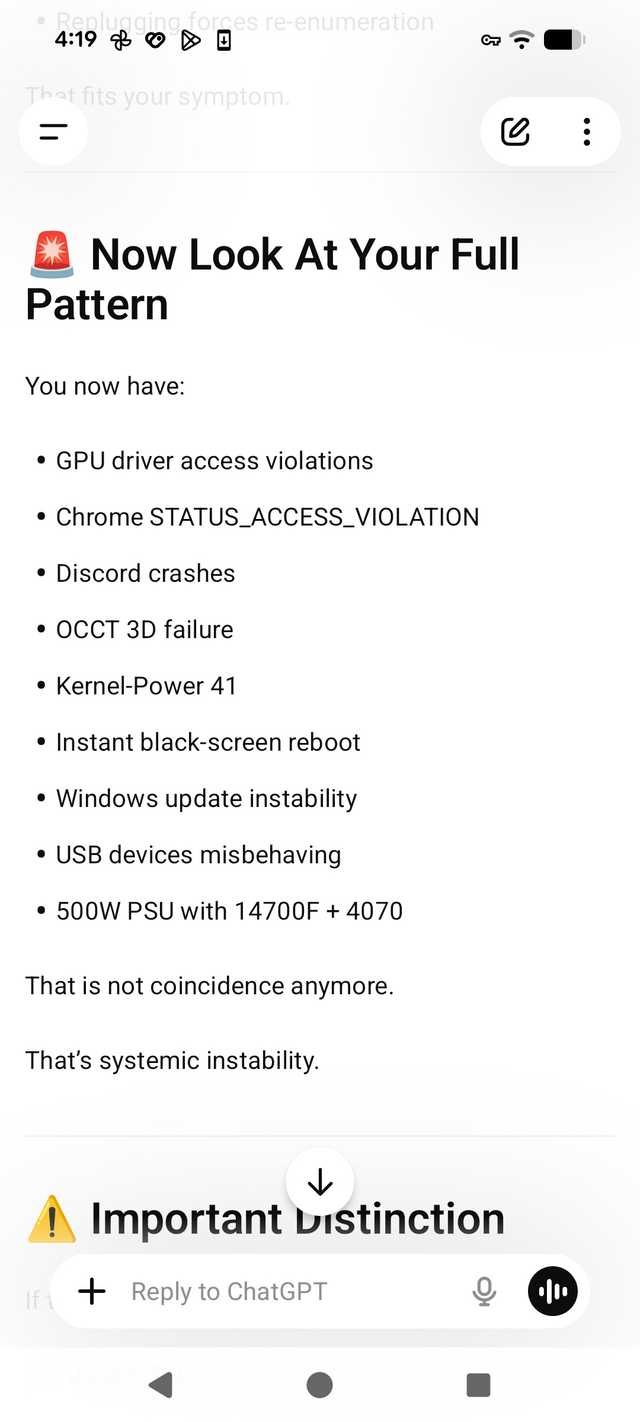

Felizmente para mim, posso reconhecer quando a IA pode estar tendo alucinações, pois sei o suficiente sobre o assunto para ver que as informações que ela transmite podem ser falsas. Mas sei que isso é difícil de fazer se você não estiver familiarizado com o assunto.

Quando eu fizer pesquisas, se possível, pedirei ao chatbot, seja Claude, CoPilot, Gemini ou ChatGPT, que forneça fontes, se puder.

Dessa forma, você pode ler a fonte completa e ver se a IA está combinando as fontes para chegar a uma resposta imprecisa. Já tive que corrigir esse problema antes.

Por exemplo, procurei uma empresa, mas havia outra com nome semelhante. Um centrou-se na investigação relacionada com STEM, enquanto o outro centrou-se puramente em finanças.

Pedi à Gemini informações detalhadas sobre o que essa empresa faz e seu histórico. Acontece que a Gemini confundiu as fontes e me deu informações conflitantes (essencialmente combinando-as em uma única empresa).

Por fim, conduzi minha própria pesquisa e vi o que estava acontecendo: combinar tudo e selecionar as informações. Infelizmente, neste caso, nenhuma das empresas era afiliada à outra.

Foi quando eu soube que precisava melhorar minha redação imediata.

Depois de algumas tentativas e erros e um pouco de pesquisa, encontrei dois prompts personalizados que realmente melhoraram as respostas que estava obtendo.

O primeiro envolvia pedir a atribuição da fonte para quaisquer respostas que daria.

O prompt usado:

Olá ChatGPT/Gemini, ao responder às minhas perguntas, você pode fornecer citações para cada reivindicação e fornecer os URLs quando aplicável. Por favor, use apenas fontes confiáveis e autorizadas.

Então, se eu descobrir que as respostas estavam erradas ou eram alucinações, enviaria a minha própria fonte e pedir-lhe-ia que produzisse uma resposta baseada nas informações fornecidas (como ponto de partida) – ou declararia que não confio nessas afirmações sem uma fonte.

Quando você conecta a IA a uma base de conhecimento confiável e selecionada ou a documentos específicos para responder, isso é conhecido como geração aumentada de recuperação (RAG). Este método ajuda a evitar que a IA produza respostas tendenciosas com base nos seus dados de treinamento.

O segundo foi um que experimentei no Reddit alguns anos atrás. Essa abordagem ajudou muito quando precisei decompor o código, entender o processo de depuração ou compreender alguns fundamentos.

O prompt usado:

Pense passo a passo. Considere minha pergunta com cuidado e pense na experiência acadêmica ou profissional de alguém que poderia responder melhor à minha pergunta. Você tem a experiência de alguém com conhecimento especializado nessa área. Seja útil e responda detalhadamente, preferindo usar informações de fontes confiáveis.

Isso ajudou muito a manter as coisas filtradas, visto que tive problemas para obter respostas reais porque o chatbot às vezes colocava muita ênfase no conteúdo gerado pelo usuário.

E, infelizmente, qualquer pessoa pode postar no Reddit e no Quora, o que muitas vezes torna difícil avaliar a precisão dessas respostas. Mesmo que a resposta tenha sido altamente votada como a melhor, isso não significa necessariamente que esteja correta.

Mantenha a IA focada e fundamentada

Um método que tenho usado ultimamente é o recurso “Pergunte ao Gemini” em meu navegador. Você também pode usar o Ask Gemini no Google Workspace para trabalhar com Planilhas Google, Documentos e muito mais.

Achei isso mais útil do que apenas abrir outra aba ou usar o aplicativo dedicado, pois mantém o Gemini focado no atual em que estou trabalhando.

Usei isso principalmente para resumir vídeos do YouTube, para poder encontrar conteúdo sem assisti-los e para encontrar informações em artigos mais longos sem lê-los completamente. Se o conteúdo for relevante para minha pergunta, assistirei ao vídeo completo e lerei o artigo.

É assim que filtro o conteúdo relevante para minha pesquisa, garantindo que o escopo da IA permaneça focado no contexto (o conteúdo da guia ou aqueles que você também compartilha com ela).

Além disso, posso verificar facilmente se as informações transmitidas pelo Gemini são realmente verdadeiras, de acordo com o contexto alimentado.

É uma ferramenta perfeita que recomendo que mais pessoas experimentem.