O OpenAI publicará regularmente os resultados das avaliações internas de segurança do modelo de IA no que o traje lançando como uma tentativa de aumentar a transparência.

Na quarta -feira, o OpenAI lançou o Hub de Avaliações de Segurança, uma página da Web que mostra como os modelos da empresa pontuam em vários testes para conteúdo prejudicial para conteúdo, jailbreaks e alucinações. O OpenAI diz que usará o hub para compartilhar estatísticas de forma “constante” e que planeja atualizar o hub com “grandes atualizações de modelo” no futuro.

Introdução do Hub de Avaliações de Segurança – Uma fonte para explorar resultados de segurança para nossos modelos.

Enquanto os cartões do sistema compartilham estatísticas de segurança com o lançamento, o hub é atualizado periodicamente como parte de nossos esforços para se comunicar proativamente sobre a segurança.https: //t.co/c8ngmxlc2y

– Openai (@Openai) 14 de maio de 2025

“À medida que a ciência da avaliação da IA evolui, queremos compartilhar nosso progresso no desenvolvimento de maneiras mais escaláveis de medir as capacidades e a segurança do modelo”, escreveu o Openai em uma postagem no blog. “Ao compartilhar um subconjunto de nossos resultados de avaliação de segurança aqui, esperamos que isso não seja apenas mais fácil entender o desempenho de segurança dos sistemas OpenAI ao longo do tempo, mas também apoiar os esforços da comunidade para aumentar a transparência no campo”.

O Openai diz que pode adicionar avaliações adicionais ao hub ao longo do tempo.

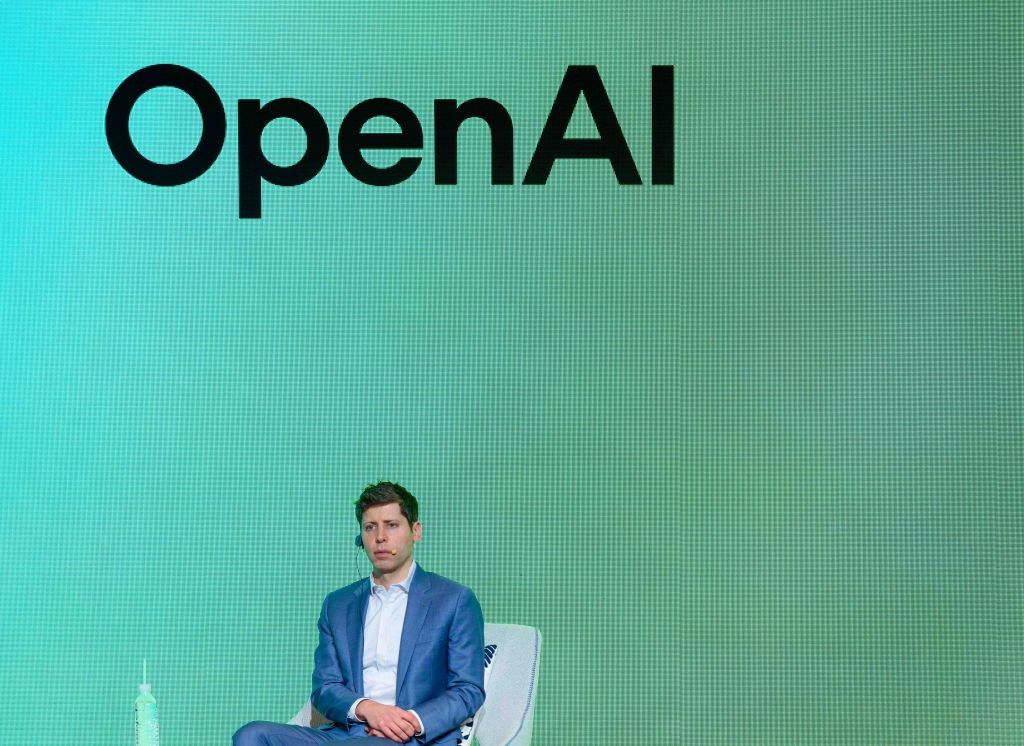

Nos últimos meses, o OpenAI aumentou a raiva de alguns ética, porque eles supostamente trouxeram os testes de segurança de certos modelos de carro -chefe e não liberam relatórios técnicos para outros. O CEO da empresa, Sam Altman, também é acusado de enganar os líderes do OpenAI sobre as avaliações de segurança do modelo antes de seu curta em novembro de 2023.

No final do mês passado, o OpenAI foi forçado a devolver uma atualização ao modelo padrão que o ChatGPT, o GPT-4O Power, depois que os usuários começaram a relatar que ele respondeu de uma maneira validadora e agradável. X foi inundado com capturas de tela do ChatGPT que aplaudem todos os tipos de decisões e idéias problemáticas e perigosas.

O OpenAI disse que implementaria diferentes correções e alterações para impedir futuros incidentes, incluindo a introdução de uma “fase alfa” de opção para alguns modelos com os quais certos usuários do ChatGPT podem testar os modelos e fornecer feedback antes do lançamento.