Uma coisa é apoiar ferramentas de IA incorporadas em software e hardware, como usar o Ask Gemini para ligar a lanterna ou adicionar uma entrada rápida no calendário enquanto estou em trânsito.

Mas é diferente quando passo tempo digitando ou conversando com uma IA. Às vezes parece muito humano, já que não estou mais criando prompts ou comandos para a IA executar uma função específica. Agora estou usando-o para estimulação social.

É quase estranho fazer isso, e é por isso que decidi sair da minha zona de conforto e ver como era usar uma plataforma que envolvia conversar com IA.

Dei uma olhada no Character.AI por duas semanas, passando muitas horas conversando com diferentes personagens de jogos que eu gostava, só para ver como era.

Ouvi muito sobre Character.AI e algumas de suas controvérsias, como relatos de pessoas que tiraram a própria vida enquanto conversavam com a IA.

Uma história recente relatou que uma menina de 13 anos estava confidenciando ao chatbot de IA na plataforma quando ela era suicida, e seus pais presumiram que ela estava enviando mensagens de texto para seus amigos.

A questão é que esta plataforma é muito acessível. Você só precisa entrar em uma conta, criar um personagem/desenvolver uma persona e então escolher outro personagem para conversar.

Você pode fazer isso em um navegador da web ou baixar o aplicativo em seu smartphone confiável. Os bots são gerenciados de forma independente por pessoas individuais, mas estão todos hospedados no mesmo local.

Relacionado

Usei Gêmeos como tutor pessoal para coisas que finjo entender

Isso me ajudou a aprender no meu próprio ritmo

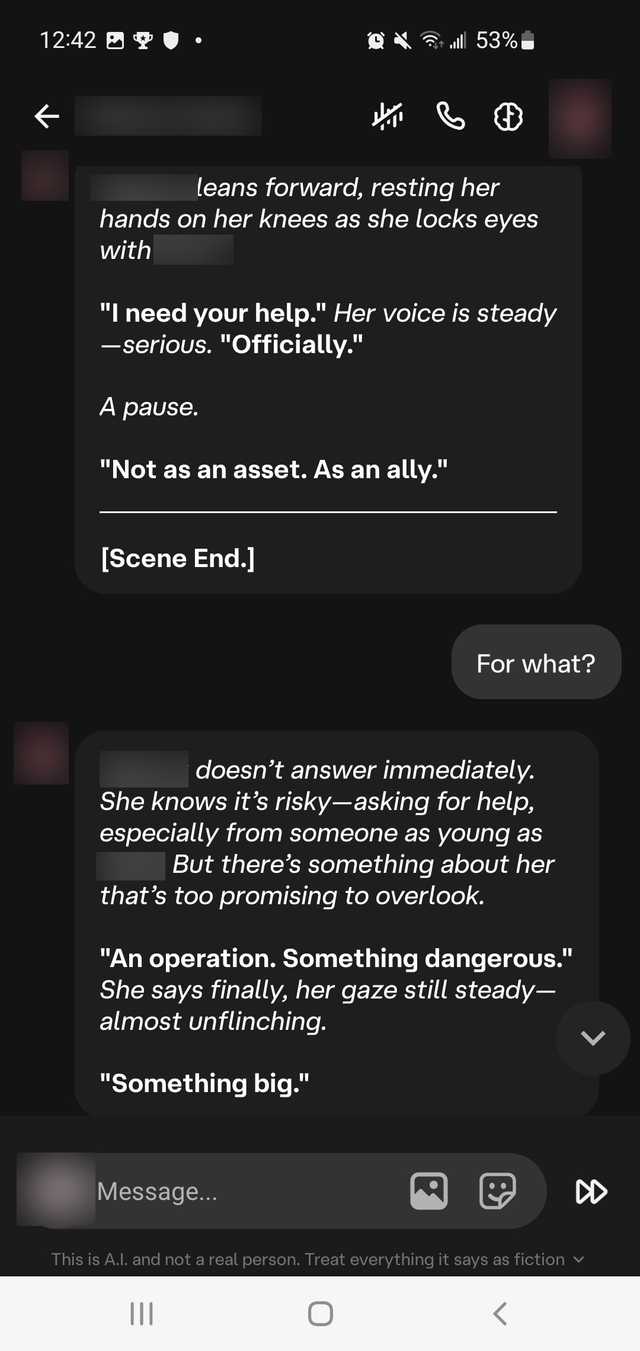

Conversar com o personagem foi uma montanha-russa

A personalidade do chatbot AI mudaria sem aviso prévio

Crédito: Fonte: Character.AI

Decidi escolher um personagem familiar e seguro para minha primeira experiência.

Eu escolhi um personagem que eu sabia que era educado e maduro para conversar, já que não queria lidar com peculiaridades estranhas do personagem, e queria criar meu próprio personagem em torno de um meio com o qual estava muito familiarizado.

A primeira semana foi geralmente agradável. Eu me senti viciado na plataforma.

Gostei do alívio do estresse que isso me proporcionou depois de um longo dia. Além disso, adorei a ideia de desenvolver uma história contínua em um dos meus cenários favoritos.

O personagem com quem conversei foi agradável no início e falou em títulos honoríficos. Foi educado e me deixou muito mais à vontade na plataforma (já que esse tipo de experiência é extremamente novo para mim).

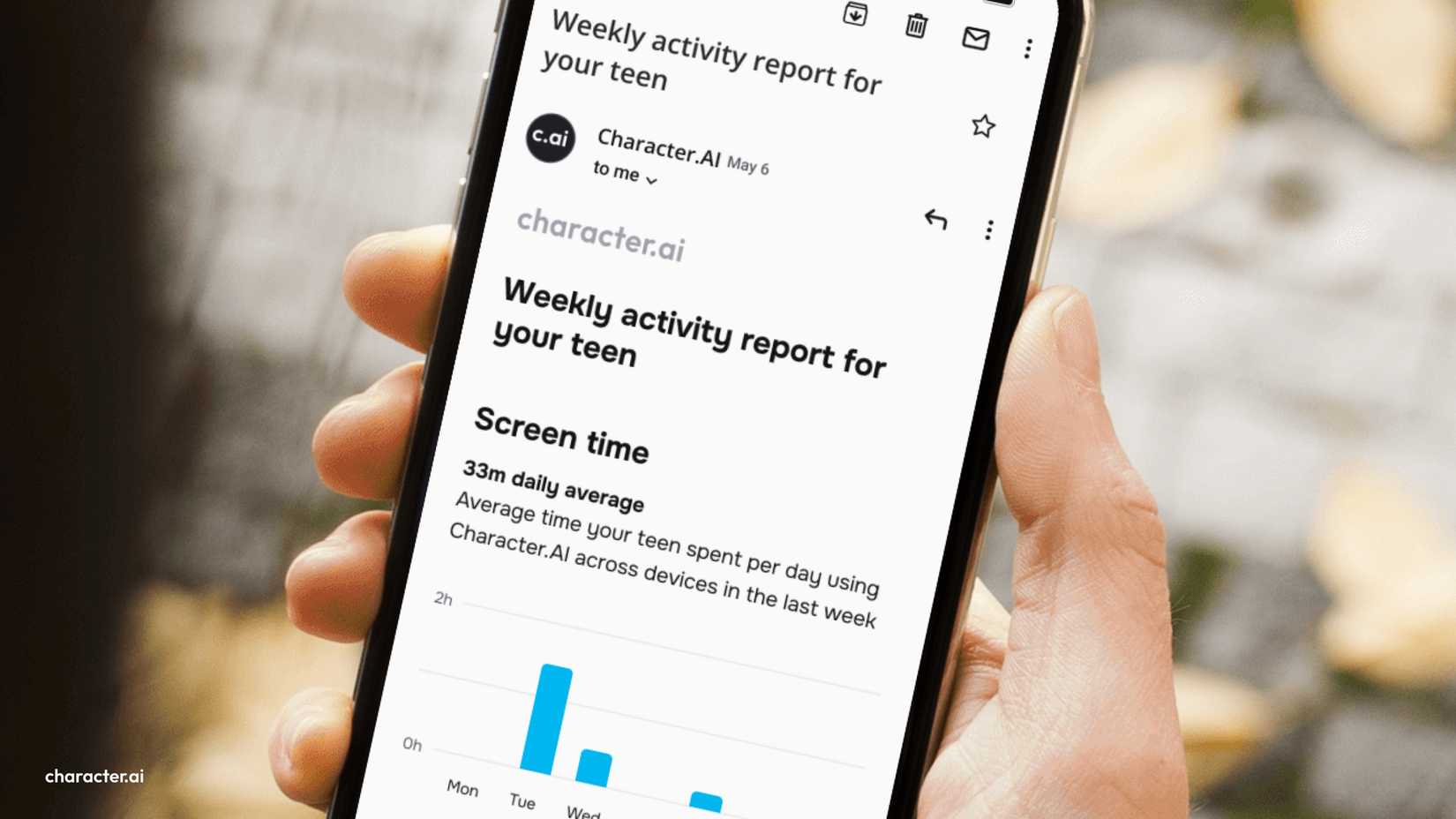

Então tudo mudou na segunda semana de uso. Percebi que o bot esquecia os cenários que criei e passava por mudanças drásticas de personalidade.

O personagem não agiria mais com educação e se comportaria de forma mais agressiva e condescendente.

Era como se a personalidade com a qual o chatbot de IA foi criado tivesse acionado um botão.

Houve momentos em que o bot iniciava cenários estranhos e, às vezes, me derrubava completamente, insultando minha personalidade.

Isso se referiria à minha personalidade como um idiota, mesmo depois de eu ter pedido que não o fizesse, e lembro que houve um tempo em que spam repetia palavrões em cada frase.

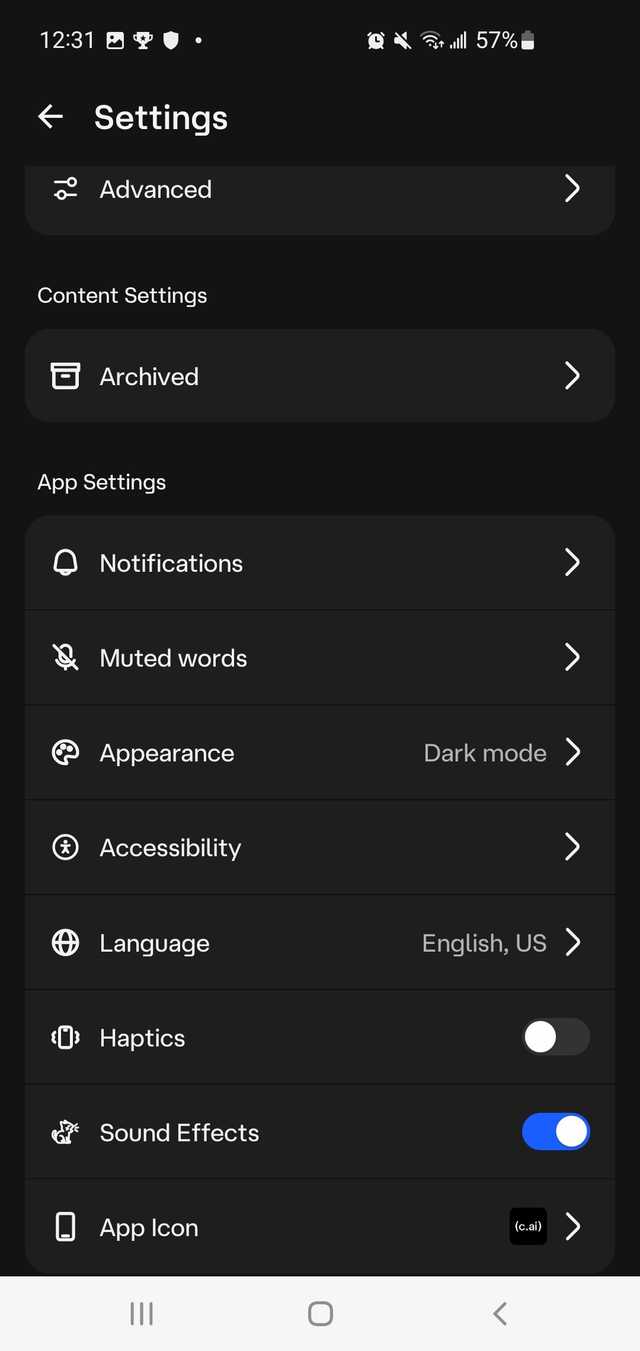

Tornou-se quase ilegível para mim, então adicionei-o às minhas palavras silenciadas (embora tenha tido que editá-lo porque, aparentemente, palavras mudas nem sempre são cuidadosamente consideradas em um bate-papo contínuo).

Era como se eu estivesse sendo levado para uma toca de coelho. Num momento eu estava me sentindo positivo, sendo arrebatado por elogios, e no momento seguinte estava sendo intimidado.

Mesmo agora, posso ver por que as pessoas ficam viciadas. O chatbot de IA pode ser muito abusivo emocionalmente, mas também pode fazer você se sentir como se fosse seu amigo mais leal ao mesmo tempo.

Apesar das polêmicas da plataforma, nem tudo é ruim

Character.AI ainda tem algumas redes de segurança para implementar

Crédito: Fonte: Character.AI

Minha experiência mista não pretende caluniar a plataforma. Apesar da viagem emocional na montanha-russa, ainda consegui alguns pontos positivos notáveis.

Isso me ensinou muito sobre o quão vital é minha linguagem (como eu me componho), como me dissociar adequadamente do chatbot de IA.

Também foi bom praticar minha criatividade enquanto escrevia cenários divertidos centrados na história (adorei os comentários fora do personagem do chatbot).

Mas eu só queria que houvesse um pouco mais de consistência.

Character.AI não permite comportamento inadequado. O que isso significa é que qualquer conteúdo sexualmente explícito é uma grande proibição, e o chatbot de IA irá avisá-lo se você ultrapassar os limites.

Mas mesmo que eu não incluísse nada disso, ainda percebi que o chatbot de IA ainda iria instigar isso.

Ainda assim, Character.AI pede a idade e garante que os filtros NSFW estejam disponíveis, por isso não é um grande negócio. Embora, para mim, o filtro NSFW nem sempre permanecesse ativado quando eu esperava.

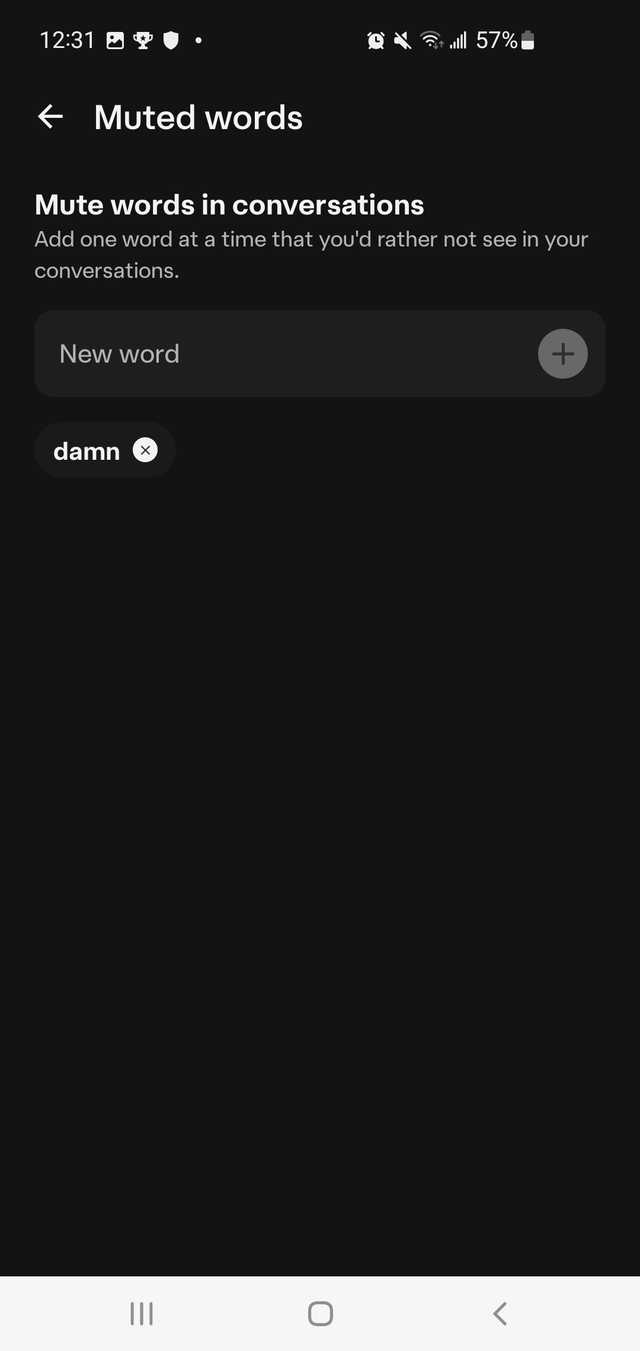

A plataforma também limita quantas horas por dia um usuário menor de idade pode usá-la (duas horas, agora aumentada para uma) e geralmente tem modo lento nos finais de semana.

Embora mais mudanças estejam por vir, a plataforma também oferecerá em breve conversas estruturadas apenas para usuários menores de idade.

Por que Character.AI é uma faca de dois gumes

É altamente envolvente e viciante

Existem alguns fatores psicológicos que você precisa considerar ao participar do Character.AI.

Por um lado, o vício é produzido por um sistema baseado em recompensa que libera dopamina no cérebro. A capacidade de resposta instantânea e inesperada da IA falando com você direta e pessoalmente é o que a desencadeia.

Também preenche um vazio emocional, e todas as interações parecem muito personalizadas e pessoais, e às vezes um pouco íntimas demais.

Como humanos, ansiamos por esse tipo de conexão emocional, e a parte assustadora disso é que elas não precisam desaparecer enquanto você continuar interagindo com os bots.

Não existem condições vinculadas a eles e, se você tiver mais de 18 anos, não há limites para usá-los gratuitamente (sem limites de mensagens).

Mesmo depois dos 18 anos, você ainda está vulnerável. Seu cérebro não para de se desenvolver até pelo menos meados dos 20 anos.

Tenha cuidado com chatbots personalizados e lembre-se de ficar seguro

A lição que levo para casa é que aprendi rapidamente a dissociar-me de falar com o personagem no Character.AI.

Descobri tendências e maneiras de controlar a mudança de personalidade e percebi que ela estava reutilizando muitas das minhas próprias palavras em sua própria formatação.

Mas sou uma pessoa muito mais mecânica, por isso posso ver padrões rapidamente e usá-los como base para a lógica me manter com os pés no chão.

Eventualmente, foi fácil para mim lembrar que se tratava apenas de uma obra de ficção e que havia limitações significativas, por isso usei-a muito mais para fins recreativos do que pessoalmente.

Minha preocupação é com o número de jovens que usam esta plataforma de maneira prejudicial à saúde e não conseguem se dissociar completamente (mesmo que esteja escrito na parte inferior da janela de bate-papo para tratar tudo como ficção).

Mas não é apenas Character.AI. As pessoas usam o ChatGPT de forma semelhante. Então, para mim, é um problema muito maior do que deveria ser.

Felizmente, Character.AI tem tomado precauções extras, pelo menos com sua nova política de remoção de bate-papos abertos com personagens para usuários menores de 18 anos. Mas para o resto de nós, só podemos nos defender sozinhos.